阅读时间大约1分钟(244字)

阅读时间大约1分钟(244字)

2025-06-25 谷歌DeepMind机器人AI模型实现本地化运行:可完成系鞋带等高难度任务

来源:豆包

该模型现在只面向可信测试计划开发者开放。

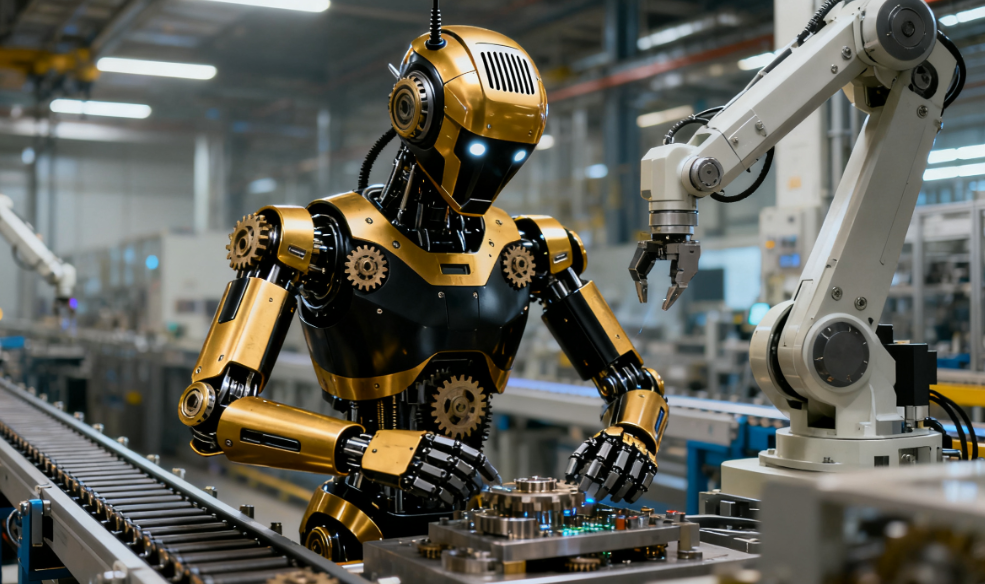

具身研习社 6月25日消息,谷歌 DeepMind 今日发布博客文章,宣布推出一种全新的 Gemini Robotics On-Device 本地化机器人 AI 模型。

该模型基于视觉-语言-动作(VLA)架构,无需云端支持即可实现实体机器人控制。核心技术能力包括:

独立运行于机器人设备,支持低延迟响应(IT之家注:适用于网络不稳定场景,如医疗环境)

完成高精度操作任务(如打开包袋拉链、叠衣服、系鞋带)

双机械臂设计,适配 ALOHA、Franka FR3 及 Apollo 人形机器人

项目负责人 Carolina Parada 表示:“该系统借鉴 Gemini 多模态世界理解能力,如同 Gemini 生成文本 / 代码 / 图像那样生成机器人动作”。

谷歌表示,该模型现在只面向可信测试计划开发者开放,基于 Gemini 2.0 架构开发(落后于 Gemini 2.5 最新版本)。

推荐阅读

×

右键可直接复制图片