阅读时间大约4分钟(1250字)

阅读时间大约4分钟(1250字)

2025-09-19 世界模型,一定是人形机器人的终局

作者:天南 出品:天南AI茶馆

如果说人形机器人有终局,那在这条路上一定无法绕过世界模型。

那有些人有疑问了:在自动驾驶里面,前几年也没世界模型,不也是跑的好好的。

是呀,世界模型对于自驾而言,是锦上添花而非雪中送炭。因为,自驾领域太过于垂直和封闭场景了(相比于人形机器人而言)。

特斯拉的FSD示意图↑

你想啊,路都是长那个样子,车辆和行人也差不多,要处理的情况虽然比较复杂,但依然在一个可控的范围内。

所以前面几年,即使没有世界模型提供的知识和能力,但没关系呀。

在国内低成本人力这么发达的地方,只要花一些小钱,开着路测车全国犄角旮旯跑起来就好了,收集到的大量数据足够用了。

但这套思路放到人形机器人上,是真的行不通了,有太多的限制(我们以后文章具体说),而解决问题的终局思路就是:世界模型。

这不李飞飞带着她最新的模型大步来了。

李飞飞,她是AI届的大佬,当时天南在交大读书的时候去追星,报告厅人山人海。她项目组的博士后,卢策吾教授就是目前穹彻智能的CEO。

李飞飞的创业公司叫world Lab↑

她在23年就坚定地认为世界模型一定是3D人类世界的终极解决方案,所以这两年一直做这块的研究。

昨天也是发布了他们团队最新的成果,我看完,真的是惊掉了。比之前提到的Genie3的物理规律和画面精致度、以及记忆功能,都要惊艳很多。

而今天,我们就来最通俗的话,来看下这篇工作工作的神奇之处,然后再看下后续如何怎么和人形机器人结合起来。老规矩重点红字认真读。

01

李飞飞关于今天世界模型的推文,非常的赞叹↑

从他们最新的推文可以看到,你只需要提供一张图像或者一段提示句子,就可以生成一段非常连续的真3D世界。

而这个3D世界生成后就会被固定下来,不会出现之前视频生成模型出来的抖动、一致性变差等问题。

你可以随心所欲的在这里面探索。

李飞飞世界模型的效果展示↑

先别管技术原理怎么实现的,我们这次只要知道她和谷歌的Genie3的区别是啥就可以了。

Genie3是一个视频生成模型,其实本质上还是2D视频流,是一个假的3D世界。

而Marble模型是一个完整且真实的3D世界,可以被抽取出3D文件进行本地化。

而我们人类的世界,也是3D世界,机器人要操作的世界也是3D世界。

这样就形成了一个非常完美的契合过程。

02

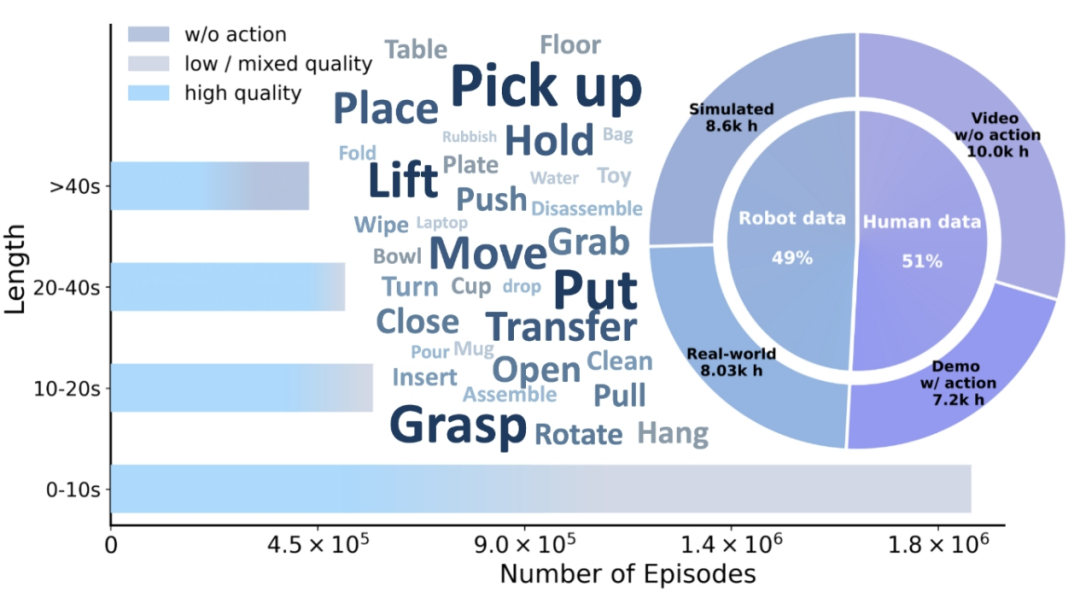

而为什么要和机器人结合起来? 以及怎么结合起来呢?本质上还是因为数据,人形机器人的数据太缺少了。不管你去看特斯拉、还是FigureAI的商业计划,都无数次地提到算力和数据。谁能够在这个数据攻克过程中,领先对手半年,谁就能够拿下人形机器人智能化量产的最关键一环。而数据中最关键的一环,就是世界模型如何和机器人结合起来。有两种方式:一种是real2real + WA(真实输入->真实动作输出 + 世界知识 )。

直接采用VLM这种模型给动作模型来做辅助参考,有点想你在机器人大脑上插了一个接口,通过这个外挂接口告诉他世界知识。这种有点像你走路的时候,你妈一直在旁边提醒你注意周围环境,是一个即时性的知识输入。另外一种就是real2sim2real(真实输入->世界知识仿真训练->真实动作输出)。

拿机器人的数据在世界模型微调,然后在最新的世界模型里面进行机器人的仿真训练,世界知识就内化在机器人里面。这种就像是你有一个平行空间,人间1天里面3年,机器人在里面模拟了所有能见到的情况,出来就是王炸。可以说是,一旦有了世界模型,机器人不单单会一项任务,会容易理解这个世界,泛化到千千万万的任务上。到了那一天,机器人走进你家我家,也就变得真实起来。