阅读时间大约10分钟以上(4778字)

阅读时间大约10分钟以上(4778字)

2025-12-08 Ilya Sutskever —— AI最伟大的“推动者”,也是其最深刻的“对峙者”

作者:陈康成 出品:机器觉醒时代

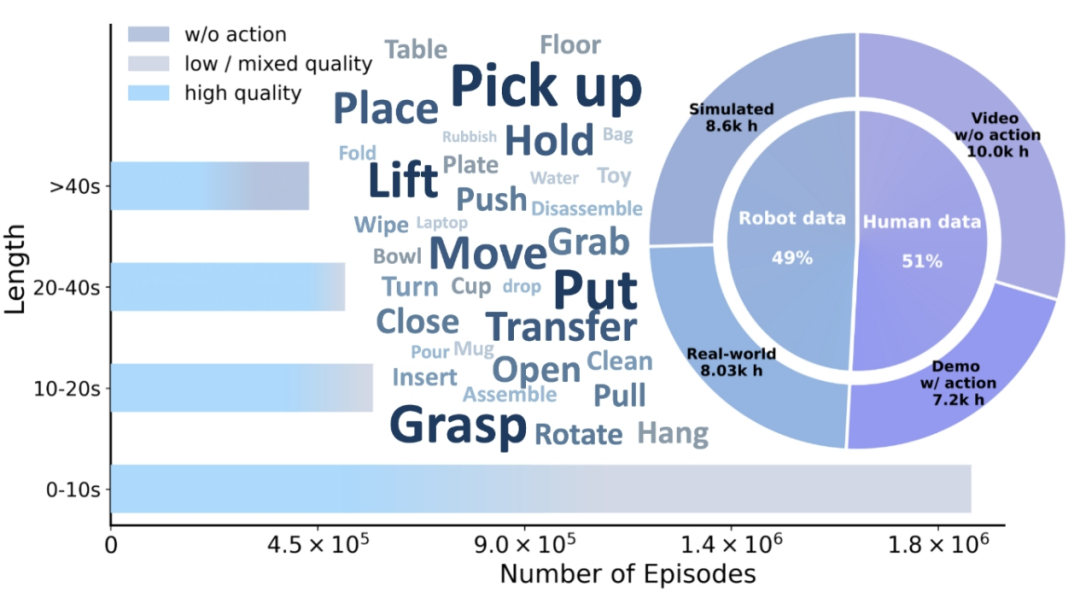

2025年11月26日,Safe Superintelligence (SSI) 创始人、前 OpenAI 首席科学家伊利亚·苏茨克维(Ilya Sutskever) 在接受知名科技播客主持人德瓦克什·帕特尔(Dwarkesh Patel )访谈节目中,又做出了震惊业界的预判:“那个单纯依赖数据和算力堆叠的‘Scaling Law(2020-2025年)时代’已经结束,我们正重新回归到一个需要探索全新算法与数据配方的‘研究时代’。”

Ilya Sutskever(左)和Dwarkesh Patel (右)

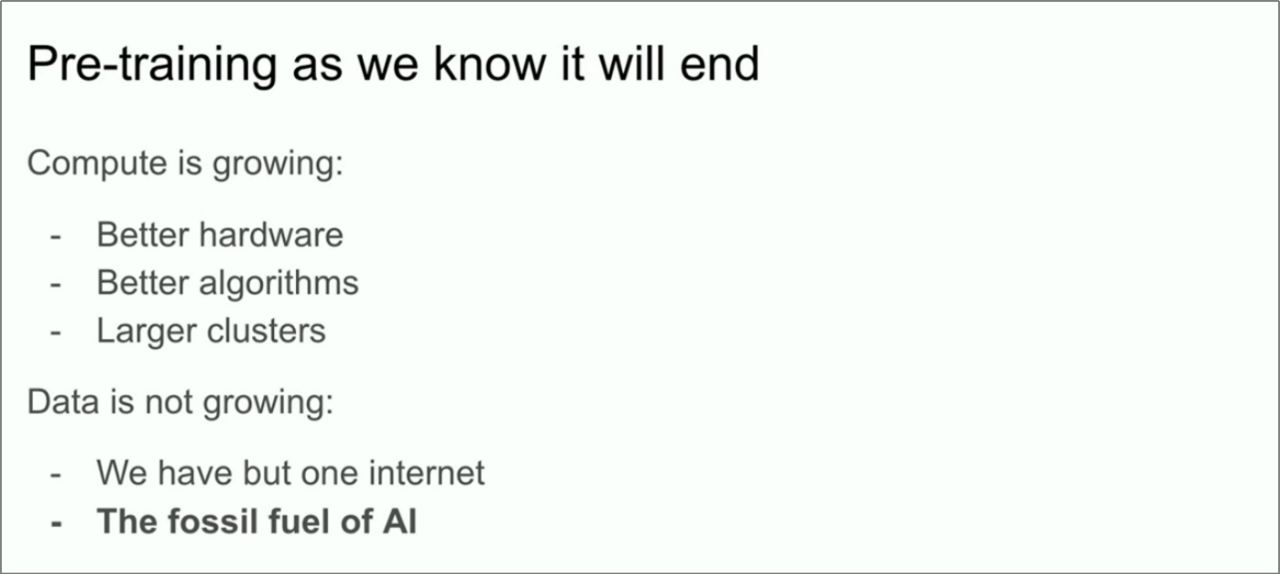

并且,在2024年的NeurIPS 会议演讲中,他就提出了类似的结论:预训练依赖于海量数据,而互联网数据存在上限,预训练时代终将结束。

预训练时代即将结束(2024年NeurIPS 会议演讲PPT)

这一预判之所以极具分量,并引发业界广泛深思和讨论,是因为Ilya Sutskever 恰恰是在十几年前就一直坚信“Scaling Law”定律,并在后来亲自在GPT-3模型上成功证明给世界看的那个男人。

甚至可以说,Ilya Sutskever已经将“Scaling Law”变成了业界的一种思维范式,并被许多人奉为圭臬。然而,正是这位“Scaling Law”最有力的证明者,如今开始洞察到它的局限性并提出了新的思考。

然而,这一深刻的洞察和预判,并非Ilya Sutskever立场的动摇,实则是其思维特质的必然体现:他始终依循一套深刻的“自上而下”的信念体系来推演技术未来。

Ilya Sutskever信念体系的核心是追求对“智能本质”的正确理解,而非盲从任何具体技术。他早期对Scaling Law的坚信,源于他认为“扩大规模”是触及智能本质的正确方向。

当Scaling Law发展到极致,他观察到模型出现了无法用“扩大规模”来解决的根本性矛盾:卓越的基准测试表现与脆弱的真实世界泛化能力之间的巨大脱节。这背离了他对“真正智能”的理解。

此时,Ilya Sutskever“自上而下”的思维特质开始发挥作用。他不会为了维护旧有路径而忽视根本矛盾,而是根据更高层级的信念(“何为真正的智能”)来重新评估当前路径。这促使他转向寻求新的、更接近智能本质的研究范式。故而,最近他又得出新结论:单纯依赖扩大规模的Scaling Law路径正在触及天花板,而与之结合的主流强化学习方法不仅算力消耗巨大,更在实现真正的智能泛化上存在本质缺陷。

Ilya Sutskever被广泛视为一位拥有罕见“研究者品位”的纯粹科学家,兼具卓越的工程直觉与深刻的哲学思维方式。正如其导师杰弗里·辛顿(Geoffrey Hinton)所评价,他拥有“惊人的原始直觉”,且从不轻信,总是致力于将新信息融入自身坚实的世界观框架中。

这种深刻的顶级赞誉,不禁让人对Ilya Sutskever 产生了浓厚兴趣。接下来,我们将追溯他的成长与求索之路,以期更深入地理解这位始终能够站在AI技术浪潮之巅,凝视着更远未来的思想者。

一、 学术深耕(2003-2013):叩开AI大门,拜师 "深度学习教父" 辛顿

Ilya Sutskever1986年12月出生于俄罗斯下诺夫哥罗德(原前苏联的高尔基市),5岁随家人移民以色列,16岁迁居到加拿大,并在多伦多大学开启求学之路。

他先后获多伦多大学数学学士(2005 年)、计算机科学硕士(2007年)及博士学位(2013)。在多伦多大学的求学之路,为Ilya Sutskever未来在AI领域的深耕奠定了坚实基石。

而这段学术生涯中,最具转折意义的,是他与"深度学习之父" 杰弗里・辛顿的相遇。据说,早在 2003 年,还是本科低年级学生的Ilya Sutskever,因对神经网络的痴迷,鼓起勇气主动敲响了辛顿办公室的大门。这份纯粹的求知欲与初生牛犊的勇气,打动了这位学术泰斗,两人自此开启了深度合作的师徒情谊。

学生时期的Ilya Sutskever,其最具标志性的成果莫过于点燃了深度学习革命的AlexNet。

2012年,仍在杰弗里·辛顿教授指导下攻读博士学位的Ilya Sutskever与同门师兄弟Alex Krizhevsky(亚历克斯·克里热夫斯基)合作,在辛顿教授的整体指导下,共同开发了划时代的深度卷积神经网络——AlexNet。

Alex Krizhevsky是网络架构的主要设计者与实现者。而Ilya Sutskever的核心贡献在于工程实现,他编写了高度优化的GPU代码,并亲自采购和搭建了由多块GTX 580 GPU组成的计算系统,为训练庞大的AlexNet提供了至关重要的算力基础。

最终,AlexNet在2012年ImageNet图像识别竞赛中以压倒性优势夺冠,其成绩远超传统方法。这一胜利被公认为深度学习革命的起点,彻底扭转了学界对神经网络的怀疑态度,并开启了人工智能的新时代。

二、谷歌时期(2013-2015):重塑NLP与机器学习基础

2012年底,在AlexNet取得突破性成功之后,杰弗里·辛顿教授与他的两位研究生Ilya Sutskever和Alex Krizhevsky共同创立了DNNResearch公司。成立之初,这家公司既无实际产品,也没有生产计划,其核心资产正是这三位深度学习先驱的顶尖才智与专有技术。

为最大化公司价值,杰弗里·辛顿为其创办的公司开展了一场小型竞价交易。该活动迅速吸引了当时对AI前沿最为敏锐的四方力量:谷歌、微软、百度,以及当时尚未被谷歌收购的明星初创公司DeepMind。

最终,谷歌在2013年3月以约4400万美元的价格胜出,完成了对DNNResearch的收购。此举被广泛视为一场经典的“人才收购”。

通过此次收购,谷歌获得了该团队在深度学习领域的专有技术。同时,辛顿教授以顾问身份为谷歌提供指导,而Ilya Sutskever和 Alex Krizhevsky则作为全职员工加入。其中,Ilya Sutskever被任命为谷歌大脑(Google Brain)团队的研究科学家。

在Google Brain期间,Ilya Sutskever分别主导和深度参与了两项影响深远的重大项目:一项革新了自然语言处理的核心框架,另一项则为整个AI社区奠定了工程基础。

1)Seq2Seq:突破序列建模的范式革命

在Seq2Seq出现之前,神经网络处理像翻译这样的任务非常棘手,因为模型要求输入和输出必须是固定长度。2014年,Ilya Sutskever与Oriol Vinyals(奥里奥尔·维尼亚尔斯)和Quoc Viet Le合作开发了序列对序列(Seq2Seq)学习算法。

该算法的核心创新在于其编码器-解码器架构:编码器神经网络将任意长度的输入序列压缩成一个固定维度的上下文向量(语义摘要);解码器则以该向量为初始状态,结合每一步已生成的内容,自回归地逐词生成目标序列,从而首次实现了端到端的变长序列转换。

Seq2Seq摆脱了传统方法对 “固定长度输入/输出” 的限制,并通过 “隐藏状态” 传递输入序列的语义信息,为后续神经模型处理复杂序列任务提供了核心框架。

2)TensorFlow:奠定深度学习的工程范式

TensorFlow是Google Brain团队于2015年推出的开源机器学习框架。TensorFlow的推出,将强大的机器学习能力变成了易用的工具。它让全球的研究者和工程师能更轻松地构建、训练和部署包括Seq2Seq在内的复杂模型,极大地加速了AI技术的民主化和工业化进程。

Ilya Sutskever作为Google Brain的研究科学家,是该项目早期的深度参与者与重要贡献者。比如,谷歌在2016年发表的关于TensorFlow的核心系统论文《TensorFlow: Large-Scale Machine Learning on Heterogeneous Distributed Systems》中,Ilya Sutskever就是核心作者之一。

三、OpenAI 时期(2015-2024):Open AI 背后的“真正大脑”

1.联合创立Open AI ,并担任首席科学家

2015年底,Ilya Sutskever做出了一个令业界瞩目的决定:放弃谷歌的高薪职位,与Elon Musk(埃隆·马斯克)、Sam Altman(萨姆·奥尔特曼)、Greg Brockman(格雷格·布罗克曼)等人共同创立了OpenAI,并担任首席科学家。

Ilya Sutskever离开谷歌、选择共同创立OpenAI,是一个由清晰信念驱动的决定。他旨在建立 一个“技术不被垄断” 的平台,根本目标是确保强大的人工智能能够以安全、负责任的方式发展,最终造福全人类。

故而,OpenAI自创立之初便确立了 “非营利组织” 的根本性质,这正是Sutskever理念的制度化体现:将对人类整体的责任置于商业利益之上。

然而,也正是这种对AI安全与公益的不可妥协的坚持,与Sam Altman所代表的、更侧重技术迭代与市场应用的发展路径之间,产生了必然的张力,成为他与Sam Altman日后公开分歧的深层根源。

2.主导了GPT-1/2/3以及DALLE系列模型的研发

作为OpenAI的联合创始人兼首席科学家,Ilya Sutskever是驱动GPT系列从概念变为现实的最高技术领导者与核心架构决策者。在他的领导下,OpenAI完成了一系列标志性的模型迭代:

GPT-1(2018年):是GPT系列乃至生成式预训练语言模型的奠基之作。它首创了 “无监督预训练 + 有监督任务微调” 的两阶段范式:首先在海量无标注文本上通过预测下一个词进行预训练,掌握通用语言规律;然后针对不同的下游任务(如文本分类、问答等)使用少量标注数据进行微调。这一范式使单一模型在多项自然语言理解任务上取得了突破性进展,为后续发展奠定了核心方法论基础。

GPT-2(2019年):作为GPT-1的突破性迭代,其参数规模提升至15亿(1.5B),并使用了更大的WebText数据集进行训练。它首次通过大规模实验证明:仅通过“预测下一个词”训练的语言模型,无需微调就能在零样本下执行翻译、问答等多种任务,从而确立了“语言模型即通用任务求解器”的新范式,为后续的规模扩展研究奠定了基础。

GPT-3(2020年):是大语言模型发展史上的一个里程碑。它在规模和性能上实现了质的飞跃:拥有1750亿个参数,使用高达45TB的数据进行训练。GPT-3的成功确立了Scaling Law的核心路径,直接催生了“提示工程”的兴起,并引发了业界对AI能力边界及其社会影响的深刻思考。

DALL-E 1(2021):是一个由AI驱动的图像生成模型。它并非GPT的衍生品,而是同样基于Transformer核心思想,在架构上进行了关键创新,将文本和图像统一表示为离散标记,并使用一个自回归Transformer模型对它们进行联合建模与生成,首次证明了神经网络能够从纯文本描述直接生成复杂且富有创意的图像。

ChatGPT (2022):OpenAI推出的对话式人工智能系统。其核心技术是针对 GPT-3.5 模型进行专门优化,以实现与人类意图和价值观的“对齐”。它取得突破的关键在于引入了 “基于人类反馈的强化学习” 训练范式。该范式并非简单的“微调”,而是一个包含三步骤的系统工程:1) 利用人类编写的对话进行有监督微调;2) 训练一个模拟人类偏好的奖励模型;3) 通过近端策略优化算法,以奖励模型为引导,大规模优化语言模型。

GPT-4 (2023):OpenAI 发布的第四代大规模多模态预训练模型,标志着大模型在推理能力与跨模态交互上的范式级跃迁。它是 GPT 系列中首个支持文本与图像双输入、并输出精准文本的模型,具备深度跨模态推理能力 —— 既能解析图表数据、识别图像中的逻辑矛盾,也能理解漫画的讽刺内核与视觉幽默。同时,其在专业学术基准(如模拟律师考试跻身前 10%)、长文本处理(支持 2.5 万字输入)和多语言理解上取得了较大突破。

3.领导“超级智能对齐”项目

2023年7月,OpenAI宣布成立“超级智能对齐”团队,由Ilya Sutskever与Jan Leike共同领导。该项目设定了一个极其雄心勃勃的目标:在四年内(2027年前),攻克如何确保比人类更聪明的超级人工智能系统与人类意图保持一致的核心技术挑战。

该项目团队认为,目前依赖人类反馈的AI对齐技术(如RLHF)无法扩展到监督超级智能。为此,团队提出了一个关键的技术路径:首先训练一个“人类水平的自动对齐研究器”,然后利用这个AI研究器,辅以大量计算资源,去解决更高级别的超级智能对齐问题。OpenAI为此承诺投入其总计算资源的20%。

在Ilya Sutskever的理念中,控制AI的潜在风险优先于其发展速度。他担心AI能力增长远超控制力,可能带来不可预测的灾难性风险。这一安全至上的理念,与公司内部追求快速产品迭代和商业化的压力形成了根本性张力。

该项目的设立本身,即是对“在资本驱动下,长期安全研究可能被边缘化”这一产业现实的前瞻性回应。最终,这种理念上的冲突在2023年11月演变为公开的董事会危机。

4. 逼宫CEO萨姆·奥尔特曼(Sam Altman)下台

2023年11月,OpenAI爆发了震惊科技界的治理危机,其核心是首席科学家Ilya Sutskever与CEO Sam Altman在AI发展路线上的根本分歧。

以 Ilya Sutskever 为代表的部分董事会成员坚持,OpenAI 必须恪守非营利初心,将防范 AGI 的潜在风险、确保“通用人工智能造福全人类”作为首要使命,严防商业利益侵蚀核心目标;而 Sam Altman 一方则主张公司的当务之急是加速产品化、寻求巨额融资并持续投入研发,以在激烈的竞争中确保生存并维持技术领先地位。

2023年11月初,双方的矛盾因一系列具体事件达到顶峰。Ilya Sutskever与当时的首席技术官Mira Murati (米拉·穆拉蒂) 秘密合作,整理了一份长达数十页的PDF备忘录,详细列举了Sam Altman在多方面(包括产品安全审批流程、内部基金归属等事务)对董事会“缺乏一贯坦诚”的证据,并通过“阅后即焚”邮件发送给三位独立董事。

在独立董事的支持下,董事会于2023年11月17日(公开宣布日)突然行动,以“沟通不坦诚”为由,投票罢免了Sam Altman的CEO职务,并解除了联合创始人Greg Brockman(格雷格·布罗克曼) 的董事会主席职务。这一决定由Ilya Sutskever和三位独立董事(共4票)做出,Sam Altman和Greg Brockman投了反对票(共2票)。

Sam Altman被罢免引发了公司内外的海啸。超过95%(超过700名)的OpenAI员工签署联名信,威胁董事会去请回Sam Altman,否则他们将集体加入微软。以微软为首的主要投资方也施加了巨大压力。

面对公司即将分崩离析的局面,Mira Murati和整个高管团队迅速倒戈,站到了Sam Altman一边。在巨大压力下,Ilya Sutskever于11月20日在社交平台公开表示“对自己参与董事会行动深感后悔”,并签署了员工联名信。

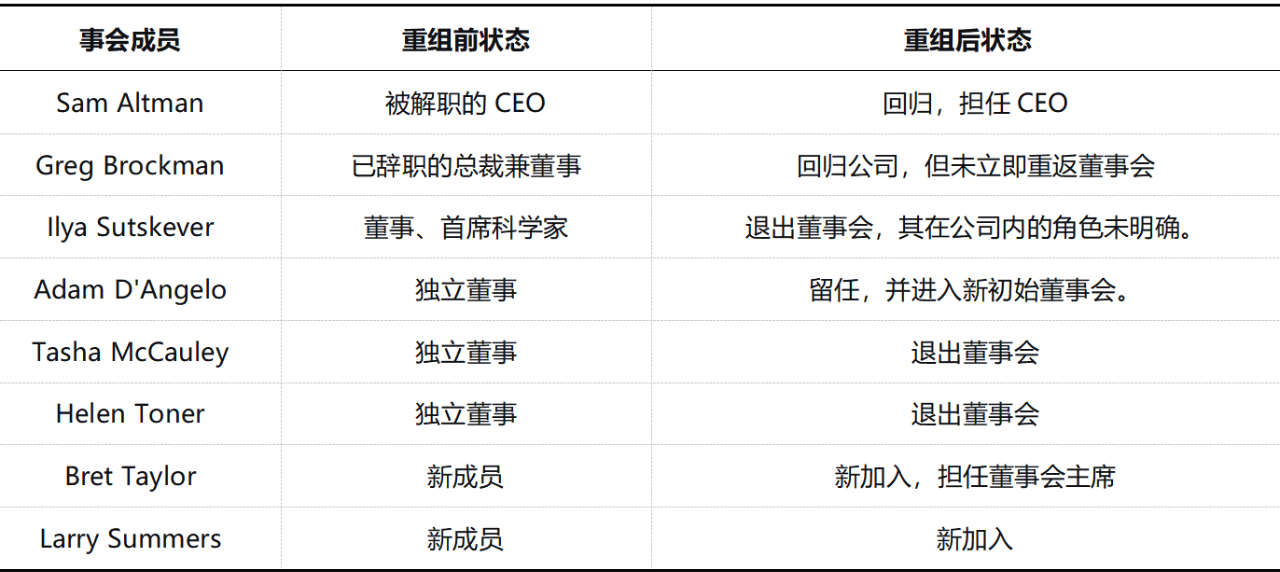

经过数日激烈谈判,Sam Altman于2023年11月21日成功回归,条件是彻底重组董事会,除Adam D’Angelo外的所有原董事(包括其他独立董事和Ilya Sutskever)均退出了董事会。

Sam Altman回归后,董事会进行重组

回归后,Sam Altman巩固了权力,组建了以商业领袖为主的新董事会,并加速了商业化进程。而Ilya Sutskever虽然保留了“首席科学家”头衔,但已被彻底边缘化,最终于2024年5月正式从OpenAI离职。

四、SSI时期(2024 - 至今):AI安全的坚定践行者

Ilya Sutskever离开OpenAI后,并于2024 年 6 月与 Daniel Gross(苹果前AI高管、Y-Combinator的合伙人)和 Daniel Levy (前OpenAI技术团队成员)共同创立公司Safe Superintelligence Inc(简称SSI)。

公司的使命非常纯粹且唯一:直接开发安全的超级智能,并明确表示,公司不会受到产品周期或短期商业压力的干扰。

SSI创立早期,公司采用高度聚焦的精英模式,团队仅有约10名员工,在加州帕洛阿尔托和以色列特拉维夫设有办公室。

成立约3个月后,SSI于2024年9月初宣布完成10亿美元的现金融资,估值超过50亿美元。投资者包括红杉资本、a16z、DST Global、SV Angel、NFDG等顶级风投。到2025年4月,SSI在完成20亿美元融资后,估值已飙升至320亿美元。

然而,在2025年6月底,联合创始人兼CEO Daniel Gross 被Meta挖走,离开了SSI。Ilya Sutskever随即宣布亲自接任CEO,并表示SSI拒绝了Meta的收购,将继续专注于原有使命。