阅读时间大约5分钟(1690字)

阅读时间大约5分钟(1690字)

2026-02-25 文本指令直接驱动,仅需0.73秒!Unitree G1跳街舞、打太极行云流水?!

作者:李鑫 出品:具身智能大讲堂

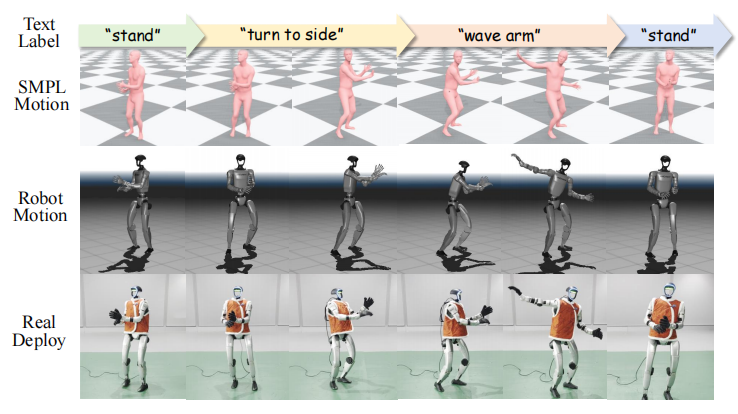

输入“深蹲左手弹吉他,转肩接竞技太极”,Unitree G1人形机器人瞬间启动动作,从蹲姿弹奏到太极招式的过渡行云流水,整个过程仅耗时0.73秒。

这不是靠的预设动作完成的,而是中国电信TeleAI研究院、上海交通大学等团队联合推出的TextOp框架带来的技术突破——全球首个真正实现实时文本交互的人形机器人运动控制系统。

PART 01

打破控制困局:从“固定脚本”到“实时对话”

长期以来,人形机器人的运动控制始终深陷两难:要么依赖预设轨迹,一旦启动就无法调整,灵活性形同虚设;要么需要人类通过动捕服、VR设备实时遥控,操作繁琐且完全依赖人力,根本谈不上自主运行。

即便是近年来兴起的文本驱动方案,也没能解决核心痛点——它们大多是先根据文本生成完整的运动序列,再让机器人“照本宣科”地跟踪执行,全程无法修改指令。如果想在机器人挥手时突然让它鞠躬,只能先中断当前动作,重新生成序列后再启动,体验十分割裂。

TextOp彻底颠覆了这种模式。它不再把自然语言当作“一次性任务指令”,而是将其视为“可实时修订的控制信号”。

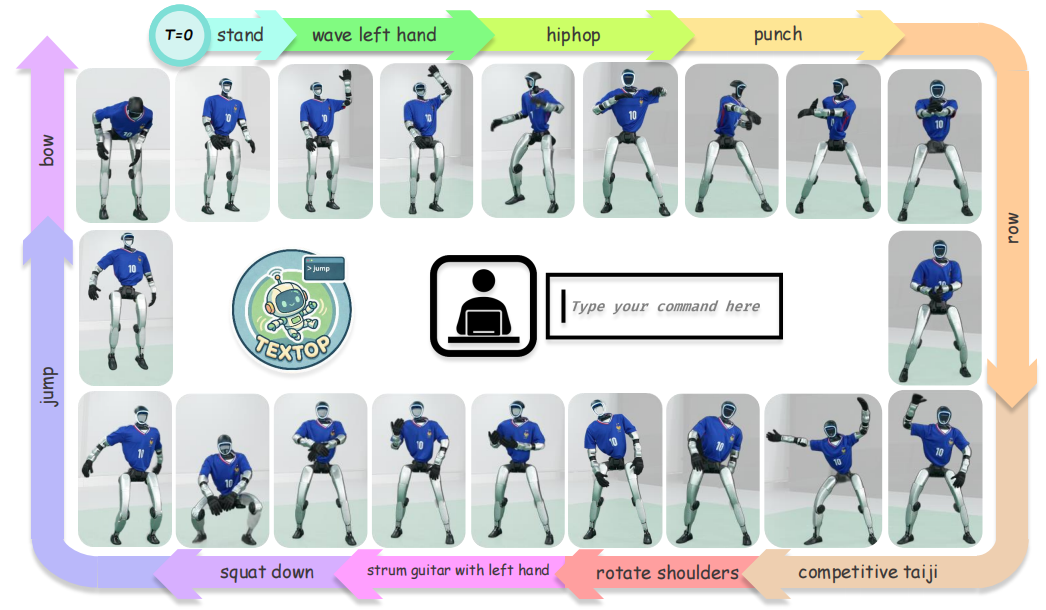

用户可以在机器人执行动作的过程中随时输入新命令,比如在“跳街舞”的过程中突然切换为“鞠躬”“挥手”,机器人能瞬间响应,在保持平衡的同时完成平滑过渡,整个运动过程不中断、不卡顿。这种“边执行边调整”的交互方式,让普通人无需专业编程知识,就能轻松操控机器人完成复杂动作组合。

PART 02

核心架构揭秘:生成与跟踪的“双级协作”

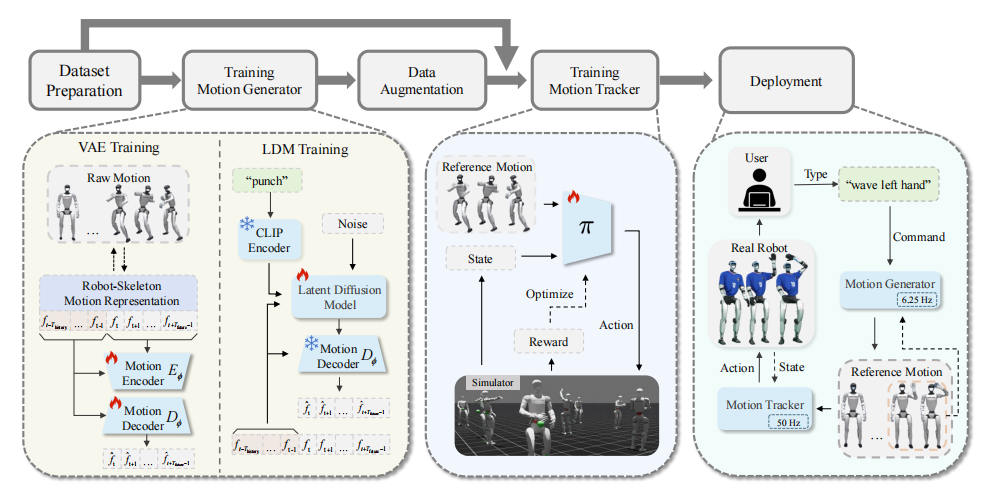

TextOp的强大性能,源于其设计的两层架构——高Level的运动生成模块与低Level的实时跟踪模块,既各司其职又深度协同,完美平衡了灵活性与稳定性。高Level的运动生成模块,就像机器人的“大脑指挥官”,以6.25Hz的频率持续输出短视域运动轨迹。

它不仅要解读当前的文本指令,还会结合前2帧的运动历史,确保生成的动作既符合语义要求,又具备物理连贯性。为了适配机器人的关节结构,团队专门设计了“机器人骨骼运动表示法”,摒弃了传统的人类运动表示方案,直接针对机器人单自由度旋转关节的特性建模,从根源上避免了运动适配时的失真问题。

低Level的运动跟踪模块,则是机器人的“肌肉执行者”,以50Hz的高频运行,将生成的轨迹精准转化为关节级控制信号。

这个基于强化学习训练的跟踪器,在IsaacLab仿真环境中经过了海量数据打磨,能在还原参考轨迹的同时,实时调整关节力度,确保机器人保持平衡。更关键的是,团队创新性地采用了“生成式数据增强”策略——用运动生成模块产出的31.48小时合成数据扩充训练集,大幅缩小了仿真与真实场景的差异,让机器人在物理硬件上的表现更稳健、更精准。

PART 03

实测数据:精度、响应、鲁棒性全面拉满

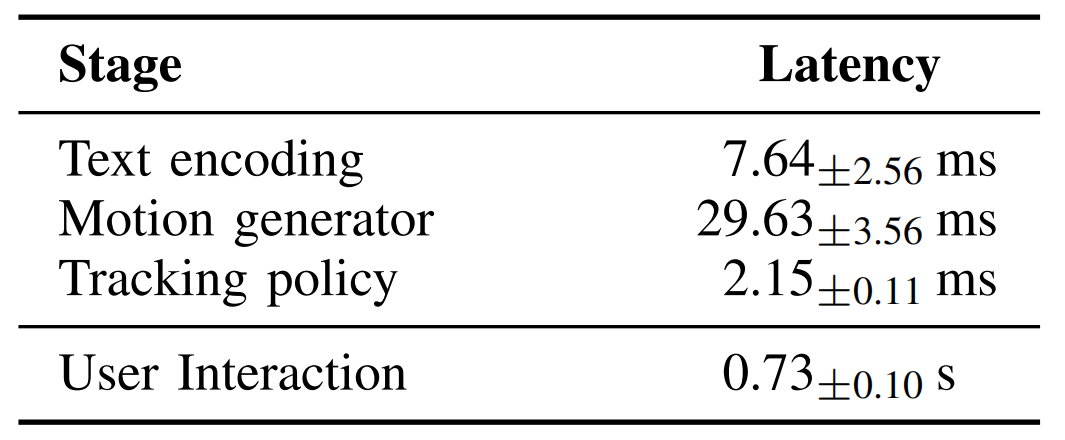

在Unitree G1机器人的实测中,TextOp的表现堪称“教科书级”。用户从输入文本指令到机器人做出响应,平均 latency 仅0.73秒,其中文本编码耗时7.64ms、运动生成耗时29.63ms、跟踪控制耗时2.15ms,每个环节都快到超出感知。

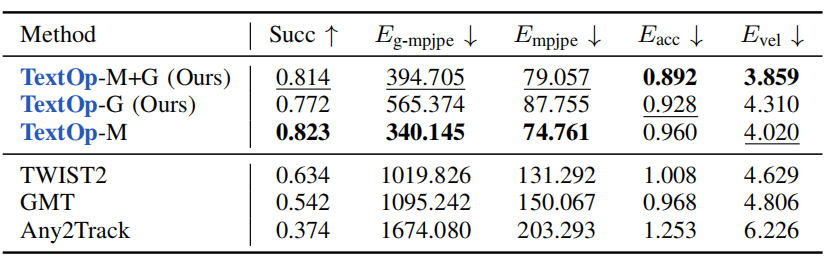

在30秒长时运行测试中,无论是随机切换的动作指令,还是“挥右手”“打拳”等循环动作,系统成功率均保持在80%以上。

其中“拉小提琴”动作的根相对MPJPE(关节位置误差)仅33.941mm,加速度误差低至0.518mm/frame²,动作流畅度堪比专业动捕设备驱动。更令人印象深刻的是其鲁棒性——测试中工作人员手动推撞机器人,它能快速调整姿态恢复平衡,同时不中断当前的动作序列,稳定性远超同类方案。

离线评估进一步验证了核心设计的有效性。在运动生成环节,TextOp的FID(分布相似度)、R@3(语义对齐精度)等关键指标均大幅超越DART+Retarget、HumanML3D等主流方案,生成的动作不仅更贴近真实运动规律,还能精准匹配文本描述。

在跟踪环节,融合了生成数据的TextOp-M+G模型,在处理生成式参考轨迹时成功率高达99.3%,远超GMT、Any2Track等传统跟踪器,即便面对从未见过的运动数据,也能保持稳定表现。

PART 04

从实验室到落地:解锁人形机器人应用新场景

目前,TextOp的开源代码和项目页面已正式上线,这意味着全球开发者都能直接基于该框架,为各类人形机器人添加自然语言交互能力。它支持的运动类型覆盖极广,从“站立”“挥手”等简单手势,到街舞、武术、乐器演奏等复杂序列,甚至能完成“爬行-深蹲-挖掘”“跳绳-踢腿-站立”这类高难度连续动作组合。

在工业场景中,工人可通过简单文本指令操控机器人完成装配、搬运等任务;在服务领域,机器人能响应“端杯水”“拥抱”等自然语言需求;

在教育场景中,学生可通过文字描述引导机器人演示科学实验动作,应用潜力无限。

当然,TextOp目前仍有提升空间——它尚未具备环境感知能力,无法根据障碍物调整动作,也缺乏物理交互推理能力。但正如研究团队所指出的,未来只需整合环境感知模块与语言模型的高阶推理能力,就能让机器人灵活应对动态场景,朝着“自主、通用”的目标迈出关键一步。

论文地址:https://text-op.github.io/static/pdf/paper.pd

f项目地址:https://text-op.github.io/