阅读时间大约7分钟(2466字)

阅读时间大约7分钟(2466字)

2026-02-26 英伟达放大招:700小时人体动作数据训练,SONIC让人形机器人像人一样灵活!

作者:李鑫 出品:具身智能大讲堂

当大语言模型早已迈入千亿参数时代,依靠上万块GPU训练出千亿级参数模型时,人形机器人控制领域却始终停留在“小打小闹”阶段,大多数控制器只有几百万参数,在单块GPU上训练几天就能完成,能实现的动作更是寥寥无几。

走路的控制逻辑无法复用给跳舞,起身的算法不能迁移到遥控操作,每增加一项新技能,就要重新设计奖励机制,这成为制约人形机器人规模化应用的核心瓶颈。

近日英伟达团队 发布了一项SONIC人形机器人通用控制框架研究团队 没有纠结于单一动作的精细优化,而是将“动作追踪”作为核心任务,通过放大模型规模、数据量和计算资源,让机器人自主习得人类运动的底层逻辑,最终实现了从跑步、跳跃到拳击、爬行的全场景自然动作控制。

PART 01

用10000小时GPU算力,喂饱机器人

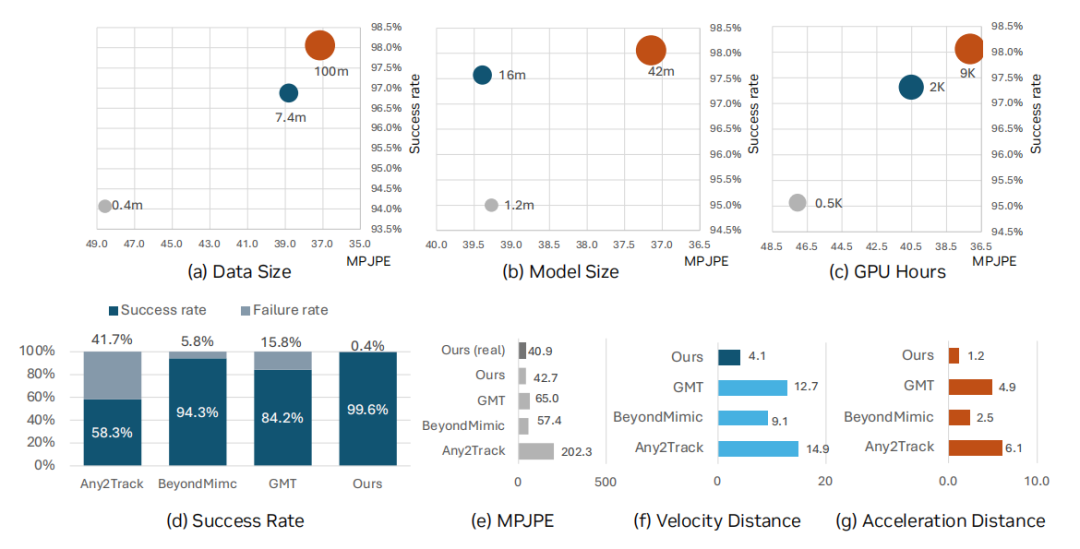

SONIC的核心思路是“规模化”,这种规模化体现在三个关键维度。模型层面,研究团队将网络参数从120万扩展到4200万,看似不算千亿级别的夸张规模,但对于需要实时响应的人形机器人控制来说,已是兼顾性能与效率的最优解。

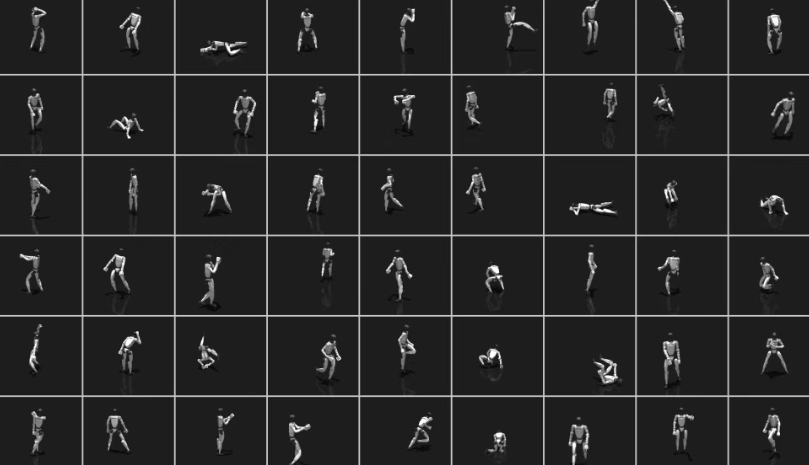

数据层面则是真正的“海量投入”。团队采集了170名受试者的运动数据,涵盖不同身高、性别,动作类型从日常行走、手势互动到格斗竞技,甚至包含多种风格化表达。这些数据累计时长达到700小时,按50帧/秒的采样率计算,总帧数突破1亿,是传统数据集的几十倍。丰富的样本让机器人能学到人类动作的共性规律,而非局限于特定场景。

(a-c) 数据集、模型和计算资源缩放至不同规模的影响。

计算资源上,SONIC动用了128块GPU并行训练,总算力消耗达到9000GPU小时,相当于单块GPU连续运行近一年。这种大规模并行训练不仅缩短了训练周期,更让模型能充分挖掘数据中的运动关联,比如从行走姿势自然过渡到奔跑,从站立状态平滑切换到下蹲。

值得注意的是,这种规模化并 不是 简单堆砌。实验显示,数据集规模的扩大带来的性能提升最为显著,模型参数和计算资源的增加则进一步巩固了效果。当使用1亿帧数据训练时,机器人对未见过的动作的追踪成功率大幅超越使用740万帧或40万帧数据的版本,充分证明了数据多样性对泛化能力的重要性。

PART 02

一个策略通吃所有动作,无需重复训练

传统人形机器人控制中,每个动作几乎都需要单独训练模型,切换动作时还会出现卡顿、不连贯的问题。SONIC通过两大核心设计,实现了“一个策略管到底”的通用控制。

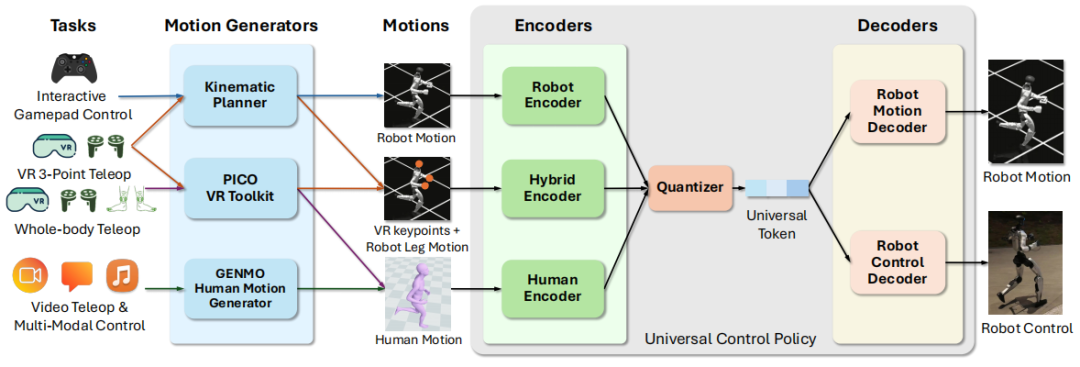

SONIC 通过一种通用控制策略实现了通用人形机器人运动追踪,该策略可处理多种运动指令和模态。

实时运动规划器

这个模块能根据用户指令,自动生成0.8秒到2.4秒的短期运动序列,并且每100毫秒就会重新规划一次,确保动作响应的及时性。在导航控制中,它支持0到6米/秒的任意速度和360度全方向移动,还能通过临界阻尼弹簧模型平滑处理突然变向等不合理指令。对于拳击这类互动场景,它不再依赖预设动作片段切换,而是实时生成连贯的出拳、格挡、移位动作,让机器人在保持全身运动自由度的同时,动作流畅度远超传统方案。

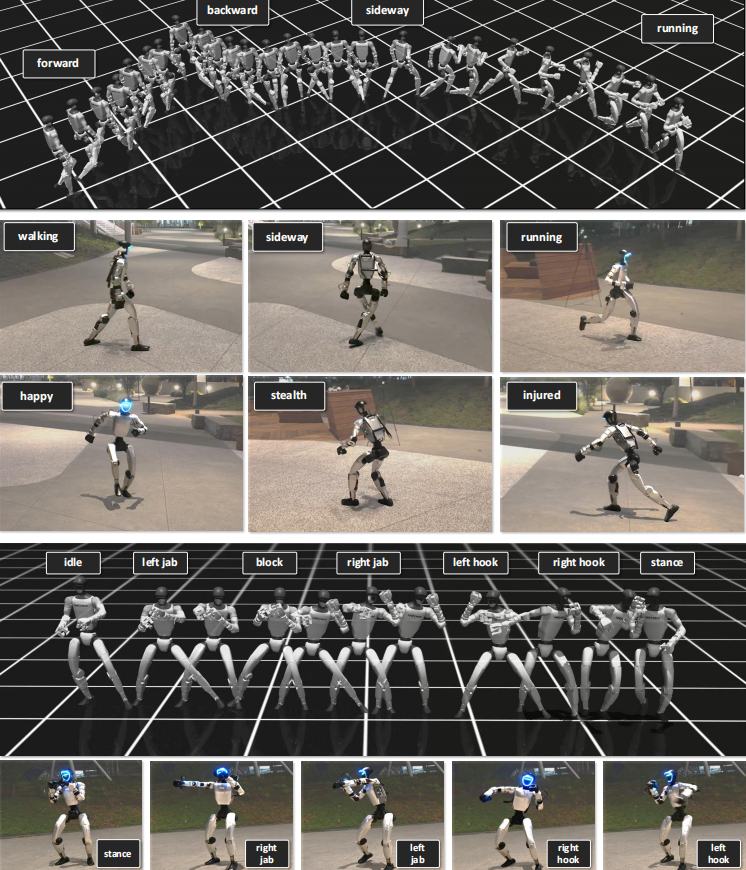

前三行:不同速度、方向和风格之间的交互式导航切换。后两行:SONIC 在整个任务过程中保持机器人完整运动自由度的同时,生成高质量且响应迅速的拳击动作。

统一令牌空间设计

更关键的是统一令牌空间设计。SONIC通过三种专用编码器,将机器人运动、人类运动、混合运动(上半身关键点+下半身机器人运动)都编码成统一格式的令牌,再通过解码器转化为机器人关节控制信号。这种设计让不同来源的控制指令都能共用同一个控制策略,无需额外适配。无论是VR设备传来的全身动作数据,还是摄像头捕捉的人类视频,甚至是文本指令、音乐节奏,都能通过这个统一接口驱动机器人运动。

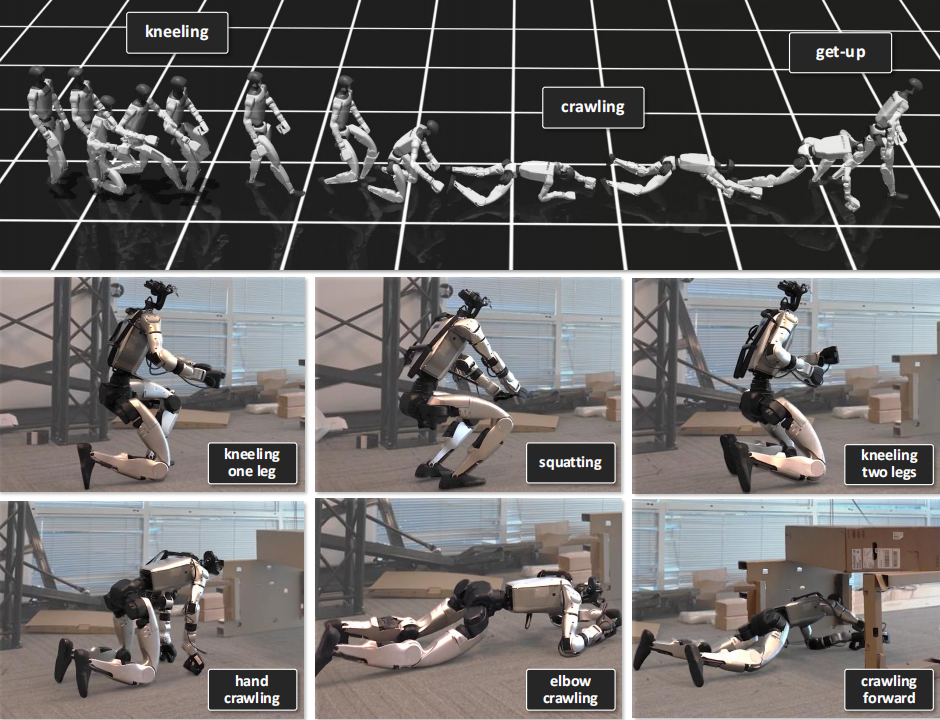

交互式深蹲、跪姿与爬行。借助 SONIC,机器人能够在任意高度完成深蹲、跪姿和爬行动作,从而可无缝应用于遥操作、复杂环境导航等现实世界下游场景 。

实验中,机器人能流畅完成深蹲、跪姿、爬行等动作,骨盆高度可在0.3米到0.8米之间任意调节,爬行时还能通过手肘和膝盖实现全向移动,这些技能都是基于同一套训练好的模型实现,无需任何额外训练。

PART 03

跨模态控制:视频、文本、音乐都能驱动

SONIC的通用性不仅体现在动作覆盖上,更在于对多种控制模态的支持,真正实现了“怎么方便怎么来”的交互体验。

视频遥操作、多模态控制及 VR 全身遥操作

视频遥控无需专业动捕设备,普通单目摄像头就能实现。系统能以每秒60帧的速度识别人类动作,无论是预录的舞蹈视频还是实时拍摄的动作,机器人都能精准模仿,姿态还原度远超传统方案。对于文本指令,机器人能实现零样本响应,输入“向前走”“左脚踢”“像猴子一样动”等自然语言,就能立即生成对应的动作,无需提前定义指令模板。

音乐控制则展现了更强的趣味性。基于GENMO运动生成模型,SONIC能分析音乐的旋律、节奏特征,自动生成同步的舞蹈动作,还能根据音乐风格调整动作幅度和节奏。更灵活的是模态切换功能,用户可以先用视频进行精细动作校准,再用文本指令调整运动方向,最后切换到音乐模式进行舞蹈表演,整个过程无需中断或重新初始化。

在VR遥控场景中,SONIC提供了两种方案:全身体感控制需要佩戴PICO头显、脚踝追踪器和手柄,能实现毫米级的动作还原;轻量化的三点遥控只需头显和手柄,通过头部和手腕姿态配合导航指令,就能让机器人完成移动、抓取等复杂任务,平均延迟仅121.9毫秒,手腕位置误差控制在6厘米以内。

PART 04

对接大模型,实现自主任务执行

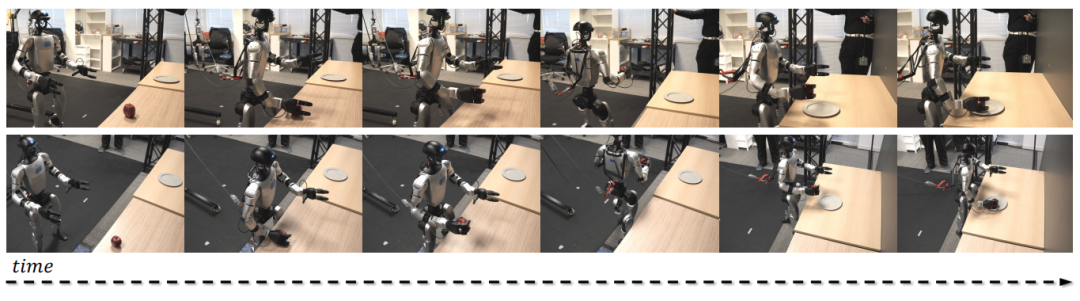

SONIC不仅能被动响应指令,还能与视觉-语言-动作(VLA)大模型结合,实现自主任务执行。研究团队通过三点VR遥控采集了300条苹果拾取-放置的演示数据,用这些数据微调GR00T N1.5模型后,机器人就能自主完成“识别苹果位置-走向桌子-抓取苹果-放置到指定盘子”的全流程任务。

在由微调后的 GR00T N1.5 视觉 - 语言 - 动作(VLA)模型控制的 Unitree G1 人形机器人上,完成苹果到盘子的移动双手操作。

在20次测试中,这套系统的成功率达到95%。VLA模型负责高层决策,比如确定苹果和盘子的位置、规划移动路径;SONIC则作为底层控制器,快速响应并执行关节运动,确保抓取动作精准、移动过程平稳。这种分工模式充分发挥了大模型的推理能力和SONIC的实时控制优势,为人形机器人自主执行复杂任务提供了可行路径。

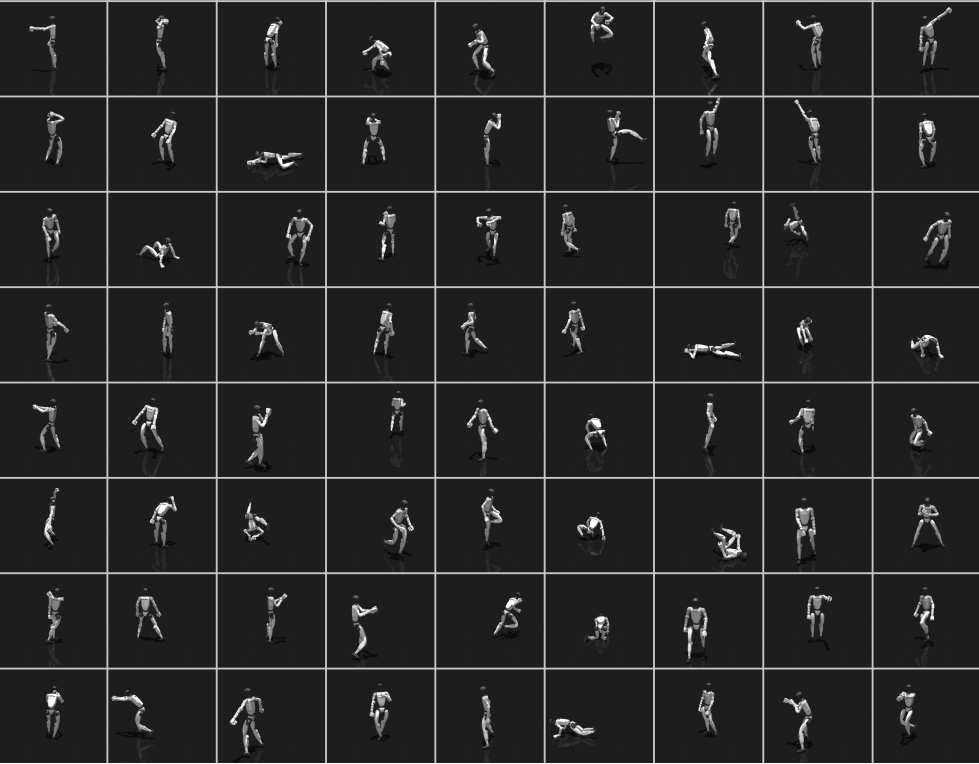

运动数据集中的随机样本

在真实场景测试中,SONIC在Unitree G1机器人上实现了零样本部署,对50种不同类型的动作轨迹(包括舞蹈、跳跃、移动操作)的追踪成功率达到100%,没有出现一次摔倒或动作失控。对比Any2Track、BeyondMimic等主流方案,SONIC在动作追踪成功率、关节位置误差、速度一致性等关键指标上都显著领先,尤其是在未见过的动作上,泛化能力优势更为明显。

当然,SONIC并非完美无缺。在长时间部署中,它的安全性、合规性和能源效率还需要进一步优化,应对嘈杂环境中的输入干扰也仍是挑战。但不可否认的是,它通过规模化训练和通用化设计,为通用人形机器人控制提供了全新思路 。

项目地址:https://nvlabs.github.io/GEAR-SONIC/

论文地址:https://arxiv.org/pdf/2511.07820