阅读时间大约6分钟(2272字)

阅读时间大约6分钟(2272字)

2026-03-16 机器人不听指令?UNC团队戳破VLA模型痛点,新方案让任务成功率飙升17%

作者:李鑫 出品:具身智能大讲堂

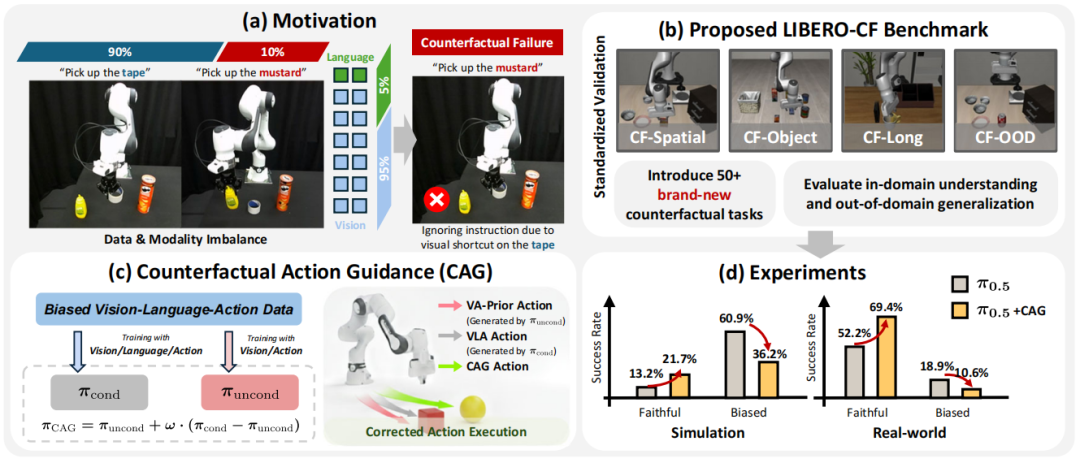

对着家用机器人说“把那边的芥末拿过来”,它却径直去抓桌面上常年出现的胶带;明明给了全新任务指令,机器人却按部就班地重复训练里最熟练的动作,这类“跑偏”行为,正阻碍Vision-Language-Action(VLA)模型从实验室走向日常场景。

北卡罗来纳大学教堂山分校的研究团队,首次全面剖析了VLAs的这类缺陷根源,并提出一套无需改动模型架构的优化方案,能让真实场景下的任务成功率平均提升17.2%,反事实失效情况大幅减少。

PART 01

视觉碾压语言:VLAs存在“先天缺陷”

VLAs模型本是连接视觉感知、语言理解与机器人动作的关键纽带,依托预训练的视觉语言模型语义能力,能把自然语言指令转化为精准的机械动作。但实际测试中,研究团队发现一个被长期忽视的问题:模型对语言指令的遵循能力严重不足。问题出在数据与模态的失衡。

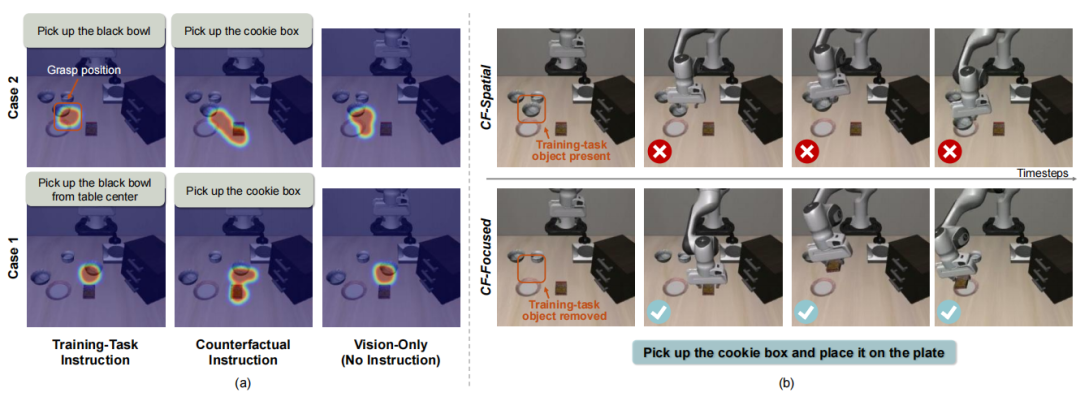

机器人训练数据集多针对特定任务,视觉信息占比远超语言信息——固定场景下,专家演示往往只覆盖少数任务,模型更易依赖视觉线索做判断,而非解读语言意图。同时,模型架构设计也加剧了这一问题:语言相关的令牌仅有几十个,而视觉令牌多达数千个,语言的影响力被严重弱化。

PART 02

LIBERO-CF:首个反事实基准,还原模型真实水平

为了系统评估VLA模型的语言遵循能力,研究团队搭建了首个反事实基准测试LIBERO-CF。该基准基于广泛应用的LIBERO机器人操作数据集,通过在相同场景布局下分配替代可行指令,全面检验模型的泛化与语言理解能力。

LIBERO-CF涵盖四类核心测试场景,覆盖不同维度的语言遵循挑战:

CF-Spatial场景聚焦空间语言接地,需要模型操作原本仅作背景的物体

CF-Object场景测试物体中心指令的切换能力CF-Long场景针对多步骤长周期任务

CF-OOD场景则引入微调阶段从未接触过的分布外物体

基准测试的评估指标精准贴合实际需求:接地率衡量机械爪是否准确接触指令指定的目标物体,反映语言遵循的忠实度;成功率要求模型完成完整任务,是更严格的执行标准。

同时,基准会统计模型“忠实执行指令”与“偏向训练任务”的比例,直接量化反事实失效的严重程度。

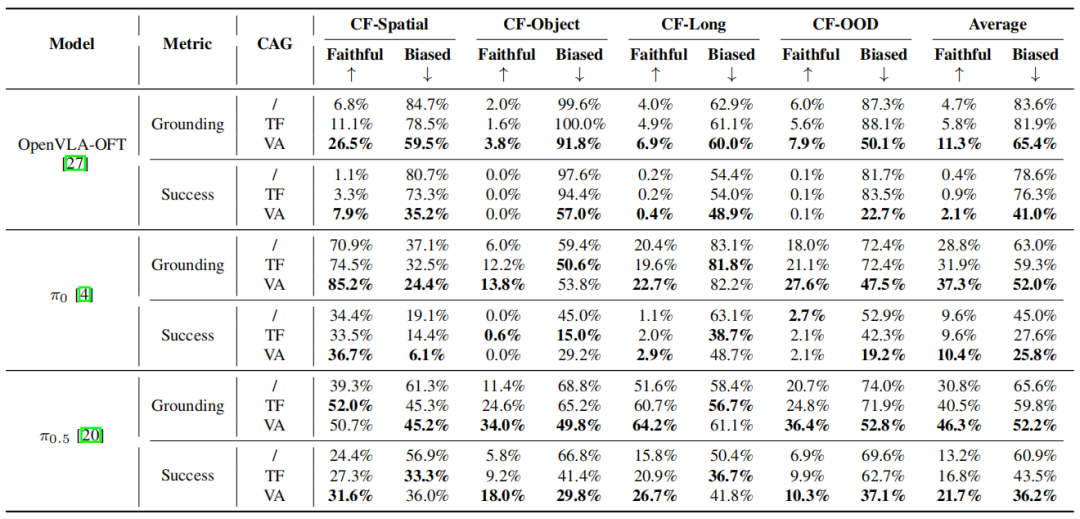

测试结果超出预期:所有主流VLA模型都存在严重的反事实失效。OpenVLA-OFT的平均接地率仅为4.7%,成功率低至0.4%;即便是性能最优的π₀.₅,平均接地率也只有30.8%,成功率13.2%。

与之形成鲜明对比的是,这些模型在“复刻训练任务”的指标上表现出色,OpenVLA-OFT的偏向接地率高达83.6%,π₀.₅也达到65.6%,这意味着模型更擅长“记忆训练任务”,而非“理解全新指令”。

PART 03

CAG方案:双分支引导,让语言主导决策

针对视觉捷径引发的反事实失效,研究团队提出Counterfactual Action Guidance(CAG)方案,核心思路是通过双分支对比,强化语言对动作的约束作用。

该方案的设计灵感源于日常决策逻辑:当我们面对熟悉场景时,会下意识依赖固有经验,但当明确有新要求时,会主动调整行为。CAG包含两个关键分支:一个是常规的语言条件VLA策略,另一个是无语言输入的视觉-动作策略。通过线性组合两个分支的输出,放大语言指令对动作选择的影响,让模型更倾向于遵循语言意图,而非依赖视觉固有经验。

为适配不同使用场景,CAG提供两种实现方式:

训练无关策略,直接利用已训练的VLA模型,在推理时通过移除语言输入近似无语言策略,无需额外训练成本

视觉-动作先验策略,专门训练一个独立的视觉-动作模型,提供更纯粹的视觉先验,与VLA模型配合使用,提升性能稳定性这套方案无需修改VLA模型原有架构,也不依赖额外演示数据,实现了“即插即用”,能有效降低模型优化的成本,适合各类现有VLA模型的迭代升级。

PART 04

CAG 方案让任务成功率最高飙升17.5%

在LIBERO-CF基准的仿真实验中,CAG的优化效果十分显著。对于π₀.₅模型,训练无关策略将平均接地率从30.8%提升至40.5%,成功率从13.2%提升至16.8%;视觉-动作先验策略进一步将接地率提升至46.3%,成功率提升至21.7%,同时让模型对训练任务的偏向性显著降低。

即便是在分布外任务中,CAG也展现出强大的泛化能力。π₀.₅搭配视觉-动作先验策略,在CF-OOD任务中实现36.4%的接地率和10.3%的成功率,有效释放了模型被视觉捷径抑制的泛化潜力。不同模型对CAG的响应存在差异:π₀.₅的视觉依赖相对较弱,改进效果更明显;OpenVLA-OFT因视觉依赖更强,需要调整引导参数才能达到最佳效果,这也说明反事实失效是一个连续问题,受模型架构、训练方式等多种因素影响。

消融实验进一步验证了方案的合理性:刻意削弱语言指令的训练效果,会导致模型性能大幅下降;而专门训练的视觉-动作模型,比直接复用原有策略效果更优,在特定空间任务中成功率提升4.3%,展现出更精准的操作能力。

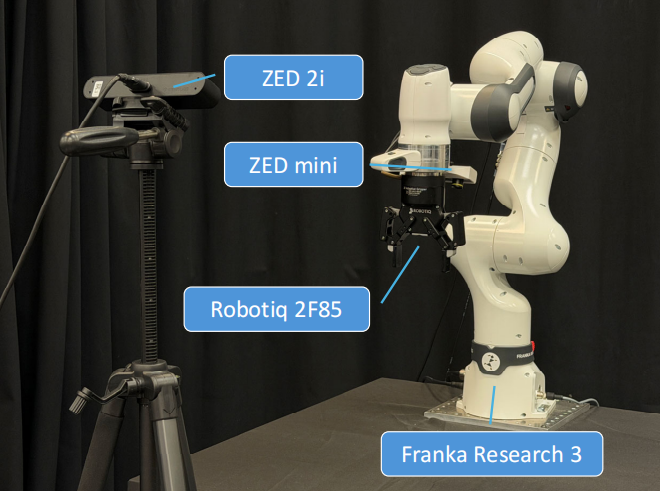

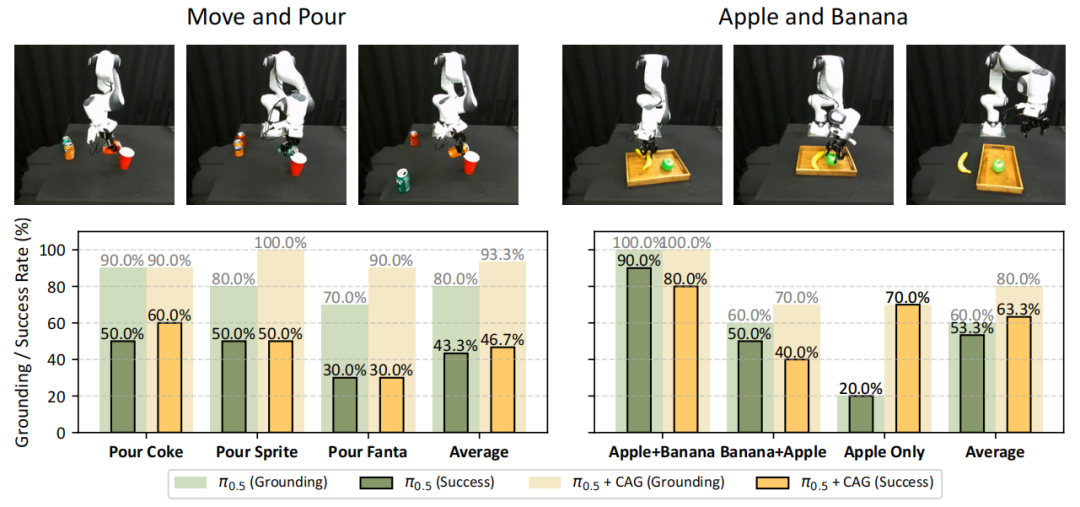

真实世界实验中,研究团队使用Franka Research 3机械臂,针对物体识别、空间推理、目标定位、分布外泛化四个维度设计场景,每个指令执行10次测试。结果显示,CAG在所有场景中都实现了稳定提升:

可乐、雪碧、芬达的物体识别任务中,CAG让平均成功率提升13.3%,接地率达到100%

空间推理任务中,模型对“左/右”等方位指令的遵循能力提升16.6%

目标定位任务中,任务成功率大幅提升36.7%,解决了模型常将物体放错位置的问题

即便是魔方、篮球等未见过的物体,CAG也能有效减少反事实失效,让模型完成零样本任务

更重要的是,这些改进并未牺牲模型原有任务性能,CAG在保留模型处理训练任务能力的同时,显著增强了语言遵循的灵活性,为VLA模型的实际部署扫清了关键障碍。

PART 05

长周期任务挑战,CAG展现稳定适配性

在长周期任务测试中,研究团队发现反事实失效会随任务步骤增加而加剧。“移动杯子并倒饮料”任务中,π₀.₅模型即便后续步骤需要特定物体,仍会默认选择训练中频繁出现的可乐;“苹果和香蕉放置顺序”任务中,模型会无视指令顺序,坚持训练时的操作序列,甚至仅要求放置苹果时,仍会额外放置香蕉。

针对这类复杂问题,CAG依然表现出强大的矫正能力。通过在多步骤执行过程中持续强化语言约束,CAG能避免早期视觉经验主导后续决策,在“倒饮料”任务中大幅减少错误选择,在“苹果放置”任务中有效抑制过度操作,证明了其在复杂场景中的稳定性与可靠性。

这项研究不仅揭露了VLA模型中普遍存在的视觉捷径问题,更通过LIBERO-CF基准和CAG方案,为模型的评估与优化提供了全新方向。对于未来服务于家庭、工业场景的机器人而言,精准理解语言指令是不可或缺的核心能力,而CAG这种轻量化、无需重构模型的方案,为产业落地提供了高性价比的选择。

论文地址:https://arxiv.org/pdf/2602.17659

项目地址:https://vla-va.github.io/