阅读时间大约8分钟(2805字)

阅读时间大约8分钟(2805字)

2026-03-20 英伟达“三位一体”布局,从数据、生态到灵巧手,目标终结夹爪时代?

出品:机器人产业应用

前言

2026年3月,英伟达开源了其最新的灵巧手操作框架EgoScale——一个在20,854小时第一人称人类视频上预训练的VLA模型。消息传出后,有开发者感叹:“UMI夹爪方案要慌了。”

这并非夸大其词。从春节前发布的DreamZero世界模型,到春节期间开源的SONIC运控基础模型,再到如今的EgoScale,英伟达在短短两个月内完成了其在具身智能领域的“三位一体”战略布局。这不仅是技术迭代,更预示着行业正从“优化算法适配简单硬件”转向“用海量数据解锁复杂硬件潜力”的范式转移。

当灵巧手在数据驱动下变得足够智能,那个靠“两个手指抓天下”的夹爪时代,是否将走向终结?而英伟达通过开源这些基础模型,又在构建怎样的物理AI生态?

核心要点

· 英伟达“三位一体”技术布局深度拆解

· 公司图谱:英伟达生态的核心玩家

· 行业趋势深度洞察

01

英伟达“三位一体”技术布局深度拆解

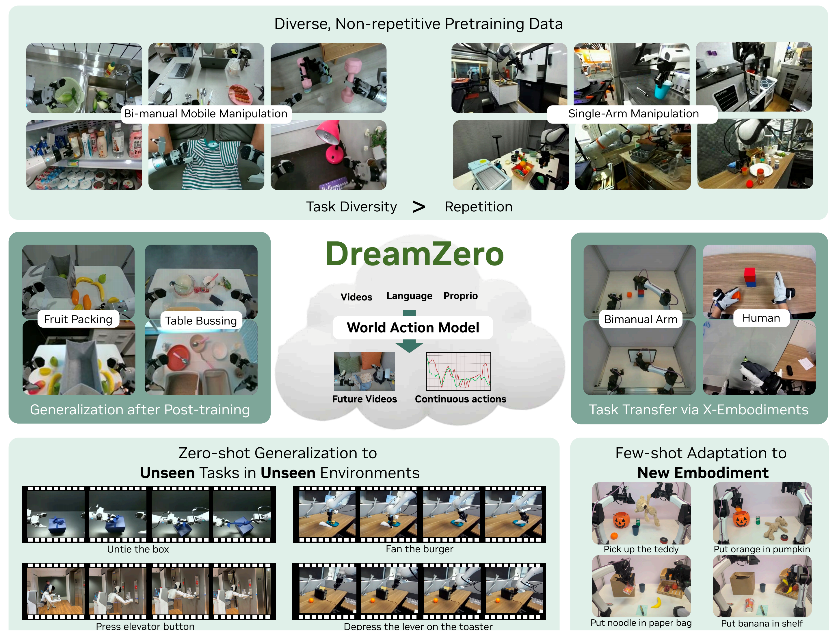

1.1 世界模型(DreamZero & Cosmos Policy):机器人的“大脑”

传统VLA(视觉-语言-动作模型)的核心问题是“懂语义但不懂物理”。它们本质上是将图像映射到文本语义空间的“翻译器”,从未被系统训练去预测动作的后果——如果机器人伸手去抓杯子,杯子会移动吗?会倒吗?会碎吗?

DreamZero的出现改变了这一局面。作为英伟达推出的世界动作模型(WAM),它通过联合建模视频与机器人动作,让模型从海量视频数据中继承了物理世界的动力学先验:重力、碰撞、运动连续性。其核心是140亿参数的自回归扩散Transformer架构,严格按照时间顺序预测视频和动作,实现了动作与画面的绝对对齐。

技术上有两个关键突破:

一是真实观测注入——在执行动作后,用摄像头捕捉的真实画面替换模型生成的预测画面,斩断误差积累;

二是DreamZero-Flash技术——通过“解耦噪声调度”,训练模型在高度模糊的视觉画面中预测精准动作,将推理时间压缩至150毫秒,实现7Hz的实时控制频率。

随后发布的Cosmos Policy进一步验证了世界模型的价值。作为基于Cosmos世界基础模型后训练的策略,它在LIBERO基准测试中平均成功率达98.5%,超越π0.5、OpenVLA-OFT等模型。在RoboCasa测试中,仅用50个训练演示就达到67.1%成功率,而传统方法需要3000个演示才能达到57.3%。

1.2 运控(SONIC):机器人的“小脑与脊髓”

如果说世界模型是机器人的“大脑”,那么SONIC就是它的“小脑与脊髓”。

SONIC(全称Supersizing Motion Tracking for Natural Humanoid Whole-Body Control)是英伟达开源的人形机器人全身控制基础模型。它的规模惊人:4200万参数,在1亿帧(超700小时)人类运动捕捉数据上训练,消耗9000 GPU小时算力。

但真正革命性的是其通用令牌空间(Universal Token Space)设计。它将所有输入——VR操控、单目视频、文本指令、甚至音乐——映射到共享的潜在表示空间,无需专门的重定向适配。这意味着:

·通过PICO头显,你可以实现VR遥操作全身精准控制

·通过单目摄像头,它能实时解析视频转动作(60+ FPS)

·通过文本或音乐指令,它能零样本执行“像猴子一样跳舞”这样的命令

更重要的是,SONIC的定位是“系统1”——快速反应层,负责全身运动控制、平衡维持、避障等实时任务。它与“系统2”(VLA/LLM推理层,负责高层规划)协同,通过实时运动学规划器在5毫秒内完成轨迹重新生成,打通了从“想”到“动”的鸿沟。这一分层架构正在成为人形机器人控制的标准范式。

1.3 灵巧操作(EgoScale):机器人的“手”

如果说DreamZero给了机器人“大脑”,SONIC给了它“小脑”,那么EgoScale就是那双“手”——而且是一双灵巧的手。

EgoScale的技术路径简单粗暴但极其有效:用人类的海量第一人称数据,结合小部分灵巧手操作手套数据,让机器人学会灵巧手操作。它首次在灵巧操作领域验证了数据规模定律——人类数据规模与验证损失、下游任务性能之间存在可预测的对数线性正相关(R²=0.9983)。

从人手到机器手需要映射。EgoScale使用了一套“对齐动作空间”,把人手的21个关键点通过非线性优化,精确转化成22自由度灵巧手(比如Sharpa手)的关节角度。再通过Manus手套采集的少量对齐数据,把人类的动作感悟锚定到机器人的电机控制上。

效果如何?在22自由度灵巧手上,EgoScale将平均成功率提高54%,并能有效迁移到低自由度手上。它展示的任务——卷衣服、发牌、试管液体转移——都是夹爪无法完成的精细操作。

02

解决方案公司图谱:英伟达生态的核心玩家

英伟达的“三位一体”布局并非单打独斗。通过开源基础模型,它正在构建一个以自身算力为核心、以生态合作为纽带的物理AI帝国。以下是这个生态中的关键玩家:

3.1 本体平台:星海图

英伟达技术的“落地试验场”,提供真实世界验证平台。

星海图的R1 Pro机器人搭载Sharpa的22自由度灵巧手,成为EgoScale的全面测试平台。2026年3月,R1 Pro落地全球首个智慧康养机器人养老驿站(北京经开区荣华街道),现场完成叠衣服任务,展示了泛化能力。

其核心优势在于数据壁垒。星海图坚持端到端VLA路线,探索遥操数据、UMI数据、egocentric视频数据的系统性采集,目标积累数十万小时级高质量数据。在Scaling Law时代,这一数据积累将成为核心竞争优势。

3.2 核心部件:Sharpa(灵巧巧手)

高自由度执行末端的代表,验证“灵巧手替代夹爪”的可能。

Sharpa在CES 2026发布了首款全尺寸人形机器人North,搭载自研灵巧手SharpaWave。技术参数令人印象深刻:

·22个主动自由度,与人手尺寸相当

·指尖定位精度亚毫米级

·每个指尖集成超1000个触觉像素单元,实现细腻触觉感知

演示能力同样惊艳:乒乓球对打反应时间0.02秒;完成30多步骤的纸风车组装,操控木棍、塑料图钉、易变形纸张等不同特性物体;结合实时视觉与语言指令完成发牌。

但挑战依然存在:99%的操作训练数据都依赖腕部摄像头,Sharpa是否需要像Figure 03一样增加掌心摄像头?这将是硬件设计需要权衡的问题。

3.3 数据采集:Manus

数据采集设备是连接人类演示与机器动作的关键桥梁,是“大规模预训练+小规模微调”范式中不可或缺的一环。

Manus(荷兰)已正式集成至NVIDIA Isaac Lab 2.3,作为原生支持的遥操作设备。其可实现,毫米级精度覆盖所有手指关节,无遮挡追踪,无漂移数据。它支持Isaac Lab内的完整遥操作与数据采集流程,数据可导入Isaac Lab Mimic进行增强和规模化。

3.4 更多生态伙伴

03

行业趋势深度洞察

3.1 从VLA到WAM:物理智能的觉醒

VLA的本质是“翻译器”——将图像映射到文本语义空间。它从未被训练去理解“如果我这么做,世界会怎样变化”。而WAM通过联合学习视频与动作的联合分布,让模型掌握“动作→画面变化”的因果链条,从而获得物理直觉。这是通往通用机器人的关键一步。

3.2 数据规模定律:新壁垒的形成

EgoScale验证的缩放定律意味着——数据规模本身就是核心壁垒。在算法趋同的背景下,谁能积累最多高质量的真实操作数据,谁就能在Scaling Law时代占据优势。这解释了星海图为何死磕数十万小时级数据,也解释了为何Manus手套这样的采集设备变得至关重要。

3.3 灵巧手替代夹爪:从“能不能”到“该不该”

过去的问题是“灵巧手太难控”,所以用夹爪。现在的问题是“有了海量数据,为什么还要用夹爪?”随着数据驱动的算法突破和摩尔定律带来的成本下降,灵巧手正从“难控的累赘”变成“最强的工具”。

当然,夹爪在特定场景(如重物搬运、简单抓取)仍有成本和可靠性优势。未来可能不是“灵巧手完全替代夹爪”,而是场景驱动的手型选择——精细操作用灵巧手,粗重任务用夹爪。

3.4 系统1+系统2:人形机器人控制的标准架构

SONIC(系统1)+ VLA/LLM(系统2)的分层架构正在成为行业标准。系统1负责快速反应(保持平衡、避障、跟随轨迹),系统2负责高层规划(任务分解、路径选择、语义理解)。

两者通过实时运动学规划器协同,在5毫秒内完成轨迹重新生成,打通了从“想”到“动”的鸿沟。这一架构的成熟,意味着人形机器人控制正在走向工程化、标准化。

04

结语

当世界模型让机器人理解物理,运控让机器人自如行动,灵巧操作让机器人精细作业,“三位一体”的拼图正在完成。而这一次,范式转移的钟声已经敲响:从优化算法适配简单硬件,转向用海量数据解锁复杂硬件潜力。

对于创业公司而言,这意味着新的机会:要么成为数据壁垒的拥有者(如星海图),要么成为核心硬件的定义者(如Sharpa),要么成为生态工具的建设者(如Manus)。

而对于整个行业,这意味着一个新时代的开始——当机器人真正拥有了“大脑、小脑和手”,具身智能的终局或许比我们想象的更近。