阅读时间大约8分钟(2917字)

阅读时间大约8分钟(2917字)

11小时前 能解奥数,不会看钟:斯坦福2026年AI报告的15个判断

作者:周华香 出品:硅星GenAI

4月13日,斯坦福大学人本AI研究所(HAI)发布了2026年度AI Index报告。400多页,覆盖技术能力、投资格局、就业影响、公众认知,是这个行业迄今最完整的第三方年度审计。

这份报告从2017年开始连续发布,今年的结论可以用一句话概括:AI的能力正在以从未有过的速度跑赢一切——跑赢监管框架,跑赢公众信任,跑赢教育体系,甚至跑赢AI公司自己对信息透明度的意愿。

以下是从报告中提炼的核心内容。

原文链接:https://hai.stanford.edu/ai-index/2026-ai-index-report

一、科学能解奥数,不会看钟

先从一个细节说起。

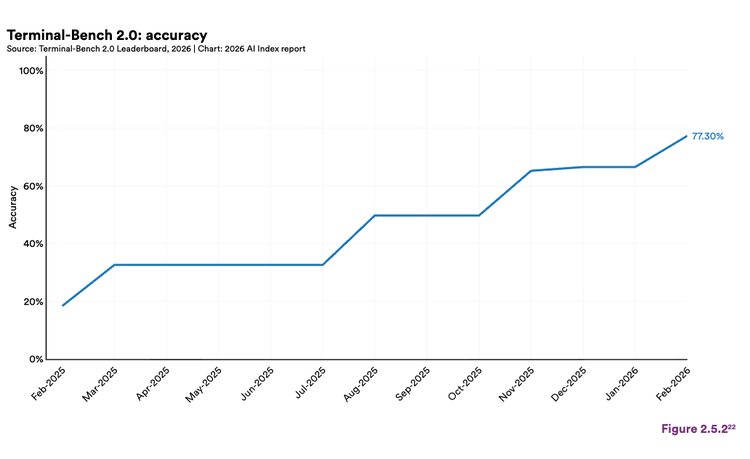

今年的报告里有一张图,横轴是时间,纵轴是AI在各类任务上相对于人类的表现。图上有一条线几乎是垂直上升的:代码能力。SWE-bench Verified——衡量AI自主完成真实软件工程任务的标准测试——在一年之内从60%跳到了近100%。同期,AI代理处理现实任务的成功率从20%跃升至77.3%,网络安全问题的解题率从15%飙到93%。

过去一年,Terminal-Bench 2.0 的准确率显著提升,从 2025 年 2 月的 20%提升到 2026 年初的 77.3%(见图 2.5.2)。

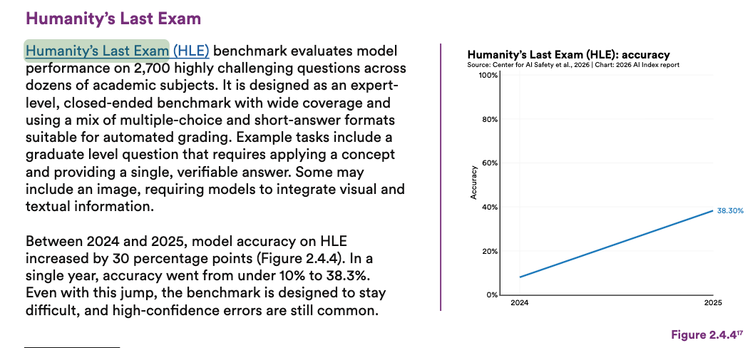

Humanity's Last Exam是一套由全球近千名领域专家共同设计的考题,专门为了难倒AI而生,覆盖物理、数学、历史、法律等几乎所有高难度学科。2025年时,排名第一的模型只能答对8.8%的题目。到今天,前沿模型的得分已经超过50%。

2024 年至 2025 年间,HLE 模型准确率提高了 30 个百分点(见图 2.4.4)。一年内,准确率从不到 10%跃升到38.3%

这不是线性增长,是跃迁。

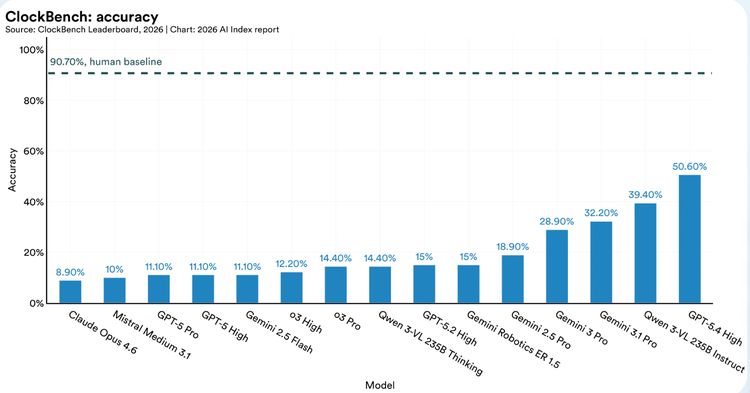

但同一份报告里,还有另一条线——机器人完成真实家务任务的成功率,折叠衣服、洗碗这类事,至今只有12%。AI仍然不能稳定地看懂模拟时钟。生成连贯视频仍然困难,多步骤规划仍然出错,某些专家级学术考试仍然答不对。

Gemini Deep Think 在 2025 年 IMO 中以自然语言进行首发工作,在 4.5 小时的时间限制内获得 35 分(金),高于 2024 年获得的 28 分银奖。在 ClockBench 上,顶级型号能正确读取模拟时钟的 50.1%,而人类则为 90.1%

能力的分布是不均匀的——某些维度已经超越了人类可以验证的范围,另一些地方仍在爬行。这是2026年AI的真实状态,也是接下来所有问题的底色。

二、美国是中国投资额的23倍,但AI人才流入已跌了89%

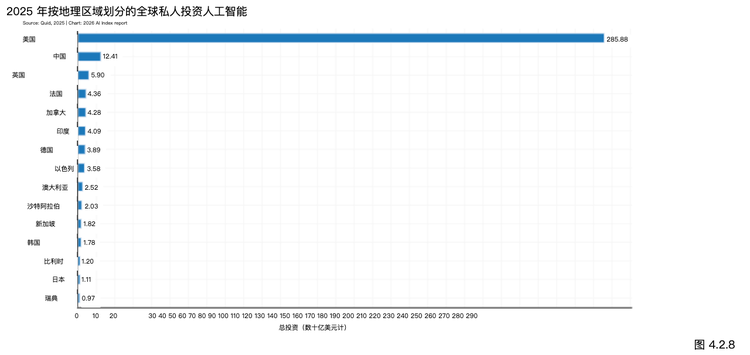

2025年,全球AI私人投资达到3447亿美元,同比增长127.5%。企业层面的AI投资总额达到5817亿美元,一年翻了一倍多。

美国在这场军备竞赛里出手最猛。2025年,美国AI投资额2859亿美元,是排名第二的中国(124亿美元)的23倍。这个差距是压倒性的。

但同一份报告里,另一组数字指向了完全相反的方向。

2017年到2026年,AI领域顶尖学者移居美国的数量下降了89%。仅在过去一年,这一数字又跌了80%。

两组数字放在一起的含义很清楚:美国在AI上砸的钱越来越多,但能用这些钱招到的最顶尖的人越来越少。钱还在涌入,但它的边际价值正在被人才流失侵蚀。

中国的投资逻辑与此不同。报告指出,单纯以私人投资额比较,会系统性地低估中国投入AI的资本体量。中国政府通过"政府引导基金"这一机制,自2000年以来在包括AI在内的各领域累计部署了超过9120亿美元。这笔钱不走市场化渠道,不出现在私人投资数据里,但它实实在在地存在。

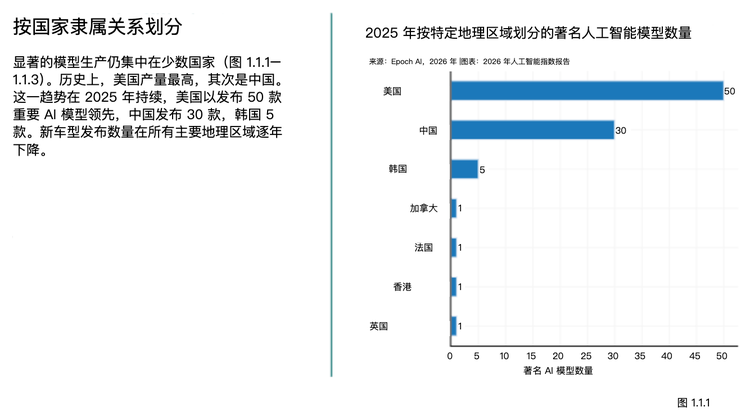

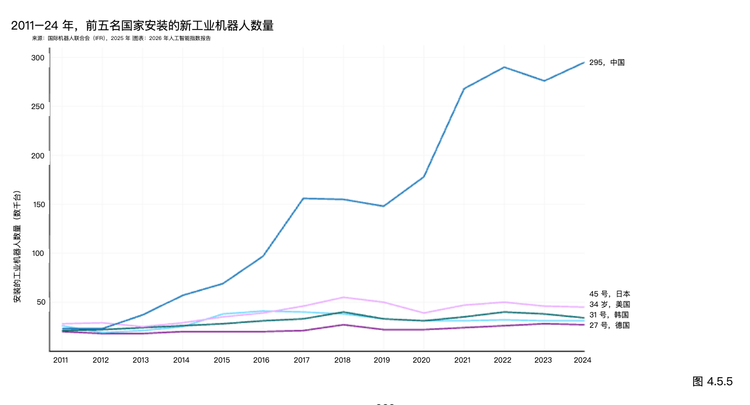

在模型数量上,美国2025年发布了50个"值得关注"的模型,中国大约30个,差距在缩小。在工业机器人安装量上,中国2024年安装了29.5万台,美国3.42万台,差距是8.6倍。中美在AI上走的是两条平行赛道,正面交锋的地方只是其中一部分。

三、22岁的程序员已经感受到了,CEO还在说AI只是工具

就业影响的数据今年第一次清晰到无法绕开。

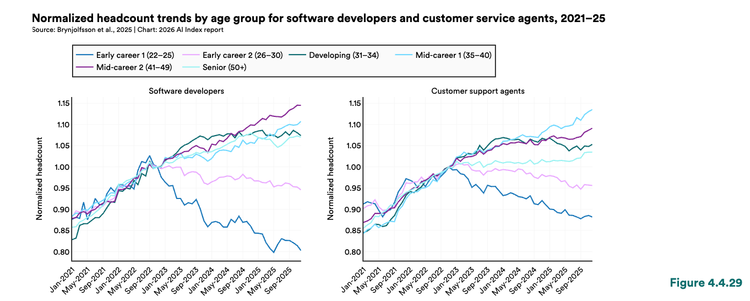

22到25岁的软件开发者,从2024年以来就业人数下降了近20%。同一时期,26岁以上的同行就业人数基本持平甚至小幅增长。这不是整个软件行业在萎缩——是AI冲击从底部开始,精准地切掉了入门岗位。

自 2022 年以来,最年轻工人(22 至 25 岁)的就业人数有所下降,尽管年长年龄段的员工人数持续增长(见图 4.4.29)。到 2025 年 9 月,22 至 25 岁软件开发者的就业人数较 2022 年峰值下降了近 20%。

客服领域同样出现了类似的模式:初级岗位在收缩,资深岗位暂时安全。

三分之一的企业高管在麦肯锡的调查中表示,预计未来一年将进一步缩减员工规模,尤其集中在服务业、供应链和软件工程。这是关于未来的计划,不是已经发生的事。已经发生的是:年轻人先感受到了。

报告的研究者同时提出了一个重要的限定:就业数据受到宏观经济的干扰,无法把AI的影响完全分离出来。但他们也指出了一个反常的现象——AI暴露程度低的职业,失业率的上升反而高于AI暴露程度高的职业。这与"AI直接替代"的简单叙事不符,背后可能有更复杂的劳动力市场重构正在发生。

AI带来的生产力提升数字,报告同样给出了:客服领域提升14%,软件开发领域提升26%。这些增益是真实的,但享受这些增益的,是已经在岗的、有经验的工人。新进入市场的年轻人,面对的是岗位数量本身正在减少的入口。

增益集中在上面,代价落在了底部。

四、模型越来越强,告诉你它是怎么训练出来的公司越来越少

有一组数字在这份报告里是最少被引用的,但可能是最重要的。

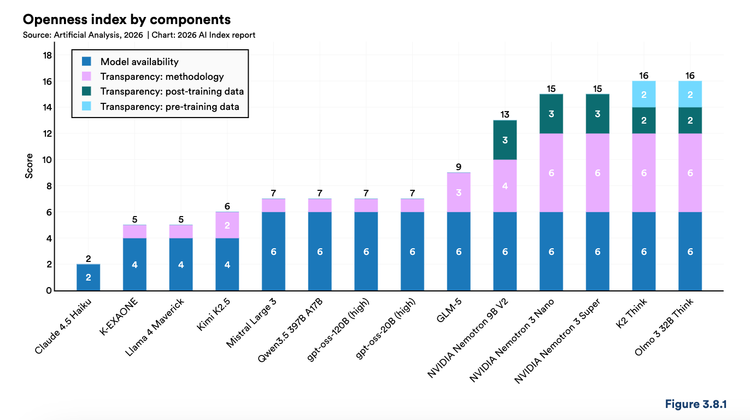

Foundation Model Transparency Index,衡量主要AI公司对其模型训练数据、计算资源、能力边界、风险及使用政策的披露程度。这个指标去年的平均分是58分,今年跌到了40分。

报告的结论更直接:在透明度最低的模型里,往往是能力最强的那批。

人工分析开放性指数根据权重的自由访问和许可程度,以及训练方法和训练前后数据的透明度,对 AI 模型进行 0 到 100 的评分。领先模型的得分较低,大多数在 100 分中的 2 到 16 分之间(见图 3.8.1)

这是一个有意思的反转。AI能力在加速进化,但公众能用来理解、审查、监督这些能力的信息,在系统性减少。大型模型的训练数据是什么、用了多少算力、有哪些已知局限——这些本来应该随着能力增强而更受关注的问题,正在随着能力增强而变得更加不透明。

公众信任的数字也在印证这件事。全球调查中,只有31%的美国人表示信任本国政府能有效监管AI,是所有被调查国家中倒数第二(中国是27%,垫底)。欧盟的数字是53%,差距明显。

与此同时,Gen Z对AI的情绪正在发生转变。他们曾是生成式AI最早的热情拥趸,现在的调查数据显示这一人群的焦虑和愤怒在上升。TechCrunch引用的一位研究者说得更直白:AI领袖们自己都在说"如果什么都不做,很多人会很惨",然后奇怪为什么公众会焦虑。

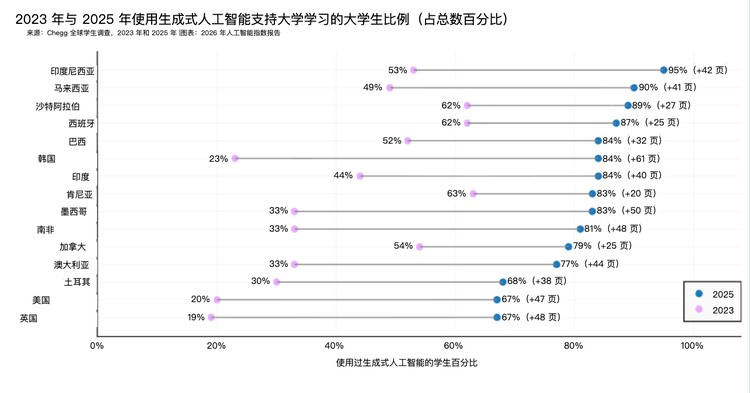

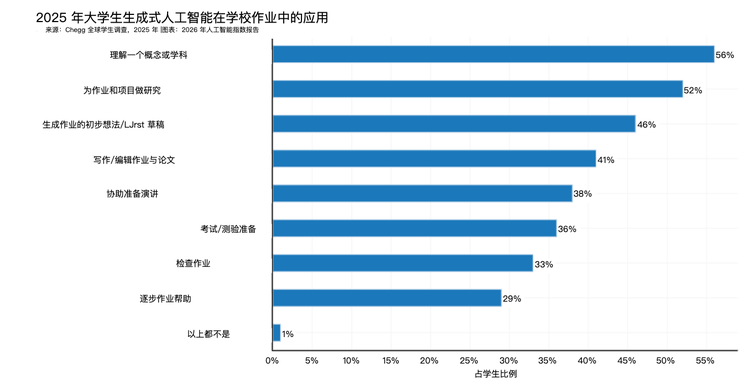

4/5的美国高中和大学生在用AI完成学业任务,但只有6%的教师表示学校有清晰的AI使用政策。能力跑在前面,框架跑在后面,中间的空白地带是每天在使用AI的几亿个普通人。

五、训练一个模型,等于1.7万辆车跑一年

AI的能力在加速,代价也在加速。只是这个代价大部分是看不见的。

报告给出的数字:xAI的Grok 4,训练产生的碳排放估计约为7.28万吨CO₂当量,相当于1.7万辆汽车行驶一整年产生的温室气体。而Epoch AI的独立估算认为这个数字更高,约为14万吨。

作为对比,OpenAI的GPT-4训练排放约5184吨,Meta的Llama 3.1 405B约8930吨。从GPT-4到Grok 4,不到两年,单次训练的碳排放增加了超过10倍。

推理侧的消耗同样在积累。全年GPT-4o的推理水耗(用于冷却数据中心服务器或水力发电),据估算可能超过1200万人全年的饮用水需求。全球AI数据中心的总电力容量达到29.6GW,相当于整个纽约州的峰值用电量,也与瑞士或奥地利的全国用电量相当。

与能源消耗同步增长的,是算力的集中度。Nvidia的GPU目前占全球AI算力总量的60%以上,而全球AI算力自2022年以来每年增长3.3倍,累计已是2021年的30倍。整个AI系统的物理基础,正在加速向少数几家硬件供应商和超大规模云服务商集中。

这些成本不会出现在AI产品的价格标签上,也不会出现在生产力提升的统计数字里。但它们是真实的,只是被分摊到了大气、地下水和电网里。

写在最后

报告里有一个细节,可以作为整篇的注脚。

AI已经能解开数学奥林匹克竞赛的题目,但仍然不能稳定地看懂模拟时钟。

这个不均匀性,不是AI的bug,是这个阶段的特征。某些维度的能力已经超出了人类可以直觉验证的范围,另一些维度还在爬行。而我们正处在这两条曲线都在快速移动的时刻——高速能力扩张,与治理、信任、透明度的同步滑落。

斯坦福的研究者在报告序言里写道:今年的报告揭示了"AI能做什么"与"我们准备好管理它没有"之间的裂缝正在变宽。这份报告本身能做的,是用数据让裂缝可见。

裂缝之后怎么办,是另一个问题。