阅读时间大约9分钟(3316字)

阅读时间大约9分钟(3316字)

2026-04-21 百亿赛道突围,未来3-5年AI玩具的进化方向

作者:李文泉 出品:机器人产业应用

前言

2025年被称为“AI玩具元年”。京东数据显示,2025年上半年AI玩具销量环比激增6倍,同比增速超200%。资本市场同步升温——2024年至今,国内已发生至少31起投融资事件,红杉中国、字节跳动、京东等头部机构纷纷入局。据《AI玩具行业白皮书》预测,2030年中国AI玩具市场规模将突破百亿元。

然而繁荣之下,同质化困境正在蔓延。200至400元价格区间内,毛绒语音玩具占据绝对主流,功能高度趋同。用户吐槽“对话机械”“除了说话什么都不会”——当新鲜感退潮,仅靠“说话”已难以维系陪伴。

行业逐渐意识到:真正的情感纽带来自物理世界中的“存在”。于是,具身交互浮出水面——让AI玩具拥有“身体”、尤其是拥有“手”,正在成为下一代AI玩具的核心命题。

关键点速览

·技术底座:会动的AI玩具是怎么炼成的?

·行业参与者图谱:两条路线,两种逻辑

·趋势展望:当“动手”成为标配

01

技术底座:会动的AI玩具是怎么炼成的?

让一个玩具从“会说话”升级到“会动手”,并非简单的电机拼装。背后是一套从感知、决策到执行的三层技术架构,每一层都面临着独特的工程挑战。

第一层:感知层——“眼睛”与“皮肤”

具身交互的前提是理解环境。玩具需要知道面前有什么、手该伸向哪里、抓取的力度该多大。这依赖多模态感知技术的融合:摄像头配合AI目标检测算法实现视觉识别,让玩具能辨认出物体和手势;触觉传感器提供力觉反馈,判断抓取是否到位;姿态估计算法则实时计算手部与目标物体的空间关系。

以开源项目Reachy Mini为例,它搭载了面部识别和手势追踪能力,能识别用户的手势指令并做出回应;可以科技的Loona则集成了仿生视觉系统,能够在桌面上自主避障、识别家人。

第二层:决策层——“大脑”的角色升级

传统AI玩具的“大脑”是一个大语言模型,负责理解用户话语并生成回复。但具身交互对“大脑”提出了更高要求:它不仅要理解语言,还要理解物理世界,并将意图转化为动作指令。

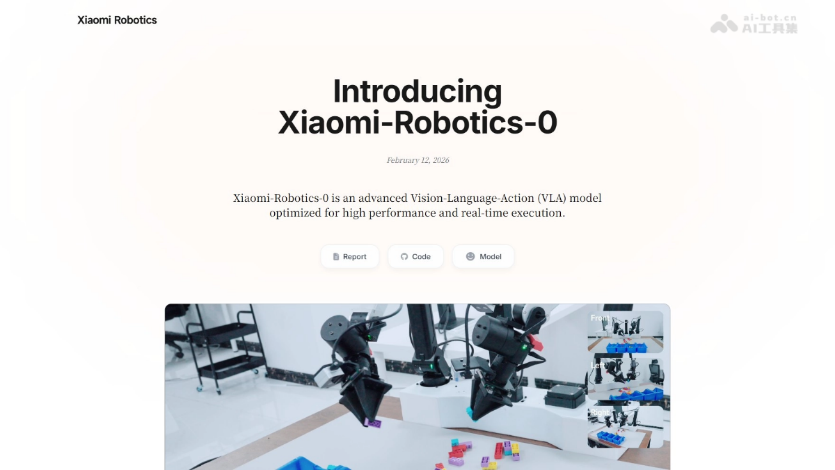

这也催生了VLA模型——视觉-语言-动作模型——这一前沿技术方向。VLA模型能够将摄像头捕捉的视觉信息与人类语言指令直接映射为机器人的关节运动序列,端到端地完成从“看到-听懂-行动”的闭环。

小米开源的Xiaomi-Robotics-0模型正是沿着这一路径探索的代表作。与此同时,百度智能云为AI玩具构建了“左脑”(逻辑推理)与“右脑”(情感交互)的双智能中枢架构,试图在理性规划与情感表达之间寻找平衡。智元机器人开源的灵渠OS则提供了跨平台的具身软件框架和基于强化学习的双足运控框架,为开发者提供了一站式工具链。

第三层:执行层——“手”的工程实现

这是具身交互AI玩具最直观也最具挑战的一环。AI玩具的机械臂和灵巧手,需要在消费级定价、儿童使用安全的前提下,兼顾精度、速度、负载能力,同时深度融合AI交互能力,避免沦为单纯的机械装置。

消费级AI玩具领域中,灵心巧手的灵心乐府钢琴机器人是典型探索,它的仿生灵巧手结合AI交互算法,可与儿童完成钢琴合奏等互动,具备AI玩具的核心属性;Reachy Mini桌面AI玩具也能通过AI视觉和语音控制完成抓取、互动等动作。

但这类具身AI玩具要成为普及型玩具,仍需市场与技术成熟——目前产品普遍价格偏高,技术上也需在高精度、低成本、高安全性上突破,这是执行层的核心痛点,也是其走向大众的关键阻碍。

三层技术架构构成了具身AI玩具的骨架,而它们能否真正走进日常生活,取决于这条产业链上不同参与者的选择——有人选择开放共享,有人选择打磨产品。

02

行业参与者图谱:两条路线,两种逻辑

当前具身交互AI玩具领域呈现出两条清晰的参与者路线:一条是由开源社区驱动的探索型项目,另一条是商业公司主导的消费级产品。它们分别服务于不同的目标人群,也代表了不同的行业演进逻辑。

路线一:开源社区——降低门槛,加速创新

开源项目以开放源代码、硬件设计图纸或软件接口为核心特征,主要面向开发者、研究者和技术爱好者。它们的价值在于将前沿技术从实验室带到公众视野,降低行业的整体研发门槛。

Reachy Mini是目前最具代表性的开源桌面机器人之一。

它由AI开源社区Hugging Face与Pollen Robotics联合推出,高度仅28厘米,重量1.5公斤,分为Lite版(299美元,需连接电脑)和Wireless版(449美元,内置树莓派5与电池)。

Reachy Mini的独特之处在于与Hugging Face生态的深度集成——用户可以直接调用平台上数千个AI模型和数据集,赋予机器人面部识别、手势追踪、语音对话、机械臂抓取等能力。

其硬件设计和软件栈均以Apache 2.0等开源协议发布,上线24小时内销售额即突破50万美元,印证了市场对这一产品形态的高度期待。

ToddlerBot则是学术开源路线的标杆。

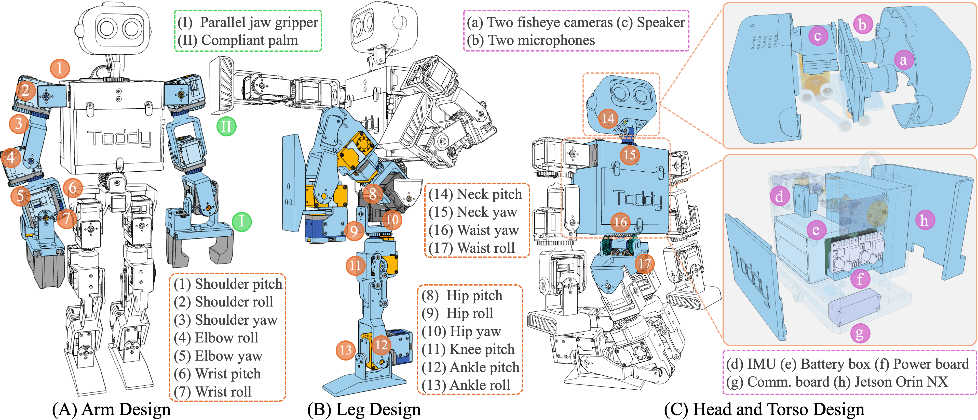

这个由斯坦福大学团队开发的开源人形机器人平台,专为可扩展的策略学习而设计。它完全基于3D打印和市售组件构建,成本控制在6000美元以内,却实现了30个主动自由度的全身移动操作能力——能够行走、抓取、搬运物体,并通过远程操作学习新的运动技能。

项目提供了详尽的组装文档和开源代码,为高校实验室和个人开发者提供了一个低成本、高上限的具身智能研究京东。

OriginMan代表了开源机器人操作系统生态的渗透。

由国内机器人技术社区古月居推出,OriginMan是首款基于ROS2全开源架构的桌面人形机器人,主控系统源码、通信协议、动作编辑软件全部开放。出厂即支持DeepSeek、Qwen等主流大模型API,为开发者提供了从AI对话到物理动作的完整链路。

此外,小智AI(基于ESP32的低成本AI语音硬件,硬件成本约79元)和StackChan(社区共创的桌面AI机器人,聚焦表情与情感表达)等项目,从更轻量级的角度降低了AI玩具的DIY门槛,构成了开源生态中不可或缺的入门级拼图。

这些开源项目的共同意义在于:它们将具身AI玩具从一个“黑箱产品”变成了“可拆解、可修改、可再创造”的开放平台。Hugging Face等头部AI社区的入局,更标志着模型生态与机器人硬件的融合正在加速发生。

路线二:商业公司——打磨场景,定义体验

与开源路线的“技术探索”属性不同,商业公司面向终端消费者,提供开箱即用的完整体验。它们的产品化能力、场景定义能力和持续运营能力,决定了具身AI玩具能否真正从小众极客圈走向大众市场。

可以科技是目前国内AI玩具赛道最具代表性的企业之一。

这家成立于2014年的公司,于2026年初完成亿元级融资。其产品矩阵覆盖了从编程教育到情感陪伴的多个场景:

ClicBot是一款模块化编程机器人,用户可像搭积木一样自由拼装成机械臂、遥控车、机械宠物等形态,主打动手能力和编程思维培养;

Loona则是一款AI宠物机器人,融合了仿生运动与视觉感知,能够识别家人、避障,并对抚摸、碰拳等动作做出反馈,定位为桌面情感陪伴;

2026年CES上发布的DeskMate进一步切入办公场景,能感知用户情绪,主动提供日程管理、邮件回复等协助。可以科技的核心竞争力在于自研的情感交互基座技术,试图在理性功能与情感表达之间建立平衡。

深庭纪则选择了一条截然不同的场景路线——户外。

这家成立于2024年的年轻公司,在2026年1月完成亿元级天使轮融资。

其产品Rovar X3是全球首款双轮足户外陪伴机器人,形态轻便,能在草地、台阶等复杂地形稳定跟随主人,并可通过标准化接口切换载物、跟拍等功能模块。

另一款产品玄影则作为技术验证平台,展示了自主踢球、与人和其它机器狗互动等能力。深庭纪强调的“态势感知”,让机器人能够在复杂环境中理解“正在发生什么”,而非被动等待指令。

在更广泛的商业产品版图中,ANKI Cozmo二代则以消费级定价提供了可编程的桌面娱乐体验。这些产品共同勾勒出一条清晰的行业趋势:商业产品正从单一的“桌面语音玩具”向特定场景深度演化,桌面陪伴、户外跟随、教育编程、任务执行等细分赛道各自涌现代表性玩家。

03

趋势展望:当“动手”成为标配

站在2026年的时间节点回望,AI玩具的演进路径已然清晰,从“桌面试点”到“场景普及”,再到“全民标配”,呈现出清晰的阶梯式递进逻辑。

短期来看(1-2年),桌面级具身AI玩具将率先完成市场验证与成熟落地。这一阶段的核心是“解决可行性”——机械臂抓取、手势交互将从高端概念,成为中高端AI玩具的标准配置,重点突破“会动手”的基础体验。

中期来看(3-5年),AI玩具将突破桌面场景,向多元化场景延伸并实现规模化普及。随着技术成熟和成本下降,户外跟随、家庭任务执行等移动能力更强的AI玩具(如深庭纪Rovar X3),将从极客玩具逐步走进大众消费市场,“户外小跟班”“家庭小帮手”等细分形态将成为新热点。

更重要的是,情感计算与物理交互的深度融合,将让AI玩具摆脱“新奇尝鲜品”的标签,从“会动手”升级为“懂陪伴”,真正融入日常生活,实现从“工具”到“伙伴”的跨越。

长期来看(5年以上),具身交互将成为AI玩具的底层能力,实现全品类渗透。当灵巧手成本降至百元级、端侧AI算力足以流畅运行VLA模型,“会动手”将不再是AI玩具的差异化卖点,而是所有AI玩具的基础配置——就像如今语音交互已成为智能设备的标配。

未来无论是桌面陪伴、教育编程,还是户外跟随类AI玩具,都将具备灵活的物理交互能力;同时,AI玩具也将与其他智能硬件联动,形成更完整的智能生活生态,重新定义人与机器的陪伴关系。

从“会说话”到“会动手”,AI玩具正在经历的不仅是一次功能升级,更是一次存在形态的质变。

当玩具开始拥有在物理世界中行动的能力,人与机器的关系也将被重新定义。这条赛道上,开源社区在降低技术门槛、加速知识扩散,商业公司在打磨产品体验、定义使用场景,两者的合力正在将具身AI玩具从概念推向现实。接下来的故事,将由技术突破、市场检验和用户选择共同书写。