阅读时间大约10分钟(3981字)

阅读时间大约10分钟(3981字)

2026-04-22 智源 VISTA:业内首个开源世界模型+VLA框架

在具身智能迈向通用机器人的进程中,Vision-Language-Action(VLA)模型已成为连接自然语言理解与机器人精细操作的核心技术路线。凭借大规模预训练,VLA模型能够直接依据语言指令生成连续动作,在标准化场景中展现出强大的执行能力。

但当模型进入真实开放世界,一个难以突破的瓶颈始终存在:分布外(OOD)泛化能力极度脆弱。面对从未见过的物体、全新的场景布局、复杂的视觉干扰,传统端到端VLA模型性能会急剧下降;同时,想要维持稳定执行,需要海量真机轨迹数据,极大抬高了技术落地成本。

近日,随着π0.7 的发布,为机器人泛化难题提供了 “世界模型 + VLA” 的全新解法。该模型采用分层规划 + 任务分解 + 多模态引导 VLA的核心思路,引入视觉目标 / 视觉示例作为显式引导,可显著提升组合泛化、空间理解、零样本跨场景和跨本体泛化能力,为通用机器人操作指明关键方向。

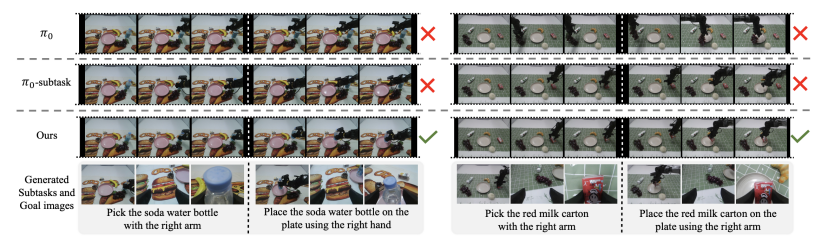

而早在两个月前,北京智源人工智能研究院便联合西安交通大学、清华大学等多校所提出了业内首个开源世界模型+VLA框架—VISTA ,与本次π0.7 采用的核心技术范式高度一致,并率先实现关键突破,在世界模型泛化性、多视角生成一致性、物理空间精准性上实现领先。与 π0.7 先通过 VLM 分解指令、再由世界模型生成subgoal的流程不同,VISTA 构建了理解与生成一体化的世界模型,无需额外引入 VLM 即可完成子任务拆解与多视角subgoal图像生成。真机实验结果表明,视觉subgoal是 VLA 突破泛化瓶颈的核心,VISTA 仅用 2 小时真机数据便达成 OOD 任务 69% 的超高成功率,而没有引入vista输出的subgoal的情况下,pi-0在这些ood任务上仅取得了14%的成功率。同时,VISTA 在 VLA 层面涌现出组合任务、空间理解与语义理解能力,相关结论与 π0.7 高度契合。VISTA 率先通过真机实验证明:世界模型输出的视觉subgoal,是让 VLA 突破泛化瓶颈的关键。

论文地址:https://arxiv.org/pdf/2602.10983

项目主页:https://vista-wm.github.io/

传统VLA与分层方法的核心局限

在真实机器人操作场景中,现有技术路线面临着难以调和的矛盾。

传统端到端VLA模型直接将语言指令映射为数十步连续动作,虽然结构简洁,但存在明显缺陷。视觉-语言模型(VLM)与VLA的训练数据结构存在本质差异,导致VLA难以继承VLM的零样本泛化能力;长时序任务的状态组合呈爆炸式增长,单一指令到动作的映射方式呈现病态且对数据存在高度依赖;在未见物体、复杂背景下,模型极易出现抓取失败、目标误识别等问题。

为缓解上述问题,一些工作尝试引入分层任务分解思路,但此方案同样存在短板。基于纯文本的子任务分解,语义泛化性较好,但无法提供精准的空间位置、抓取姿态等物理约束;基于稠密视频预测的方法,虽然细节丰富,但长时序执行中会出现明显漂移,物理一致性差,且容易产生视觉幻觉。

正是在这样的背景下,VISTA框架找到了全新的技术路径:借助世界模型生成稀疏、物理可信的视觉subgoal,以文本+视觉双模态里程碑,连接高层语义规划与底层精准执行。

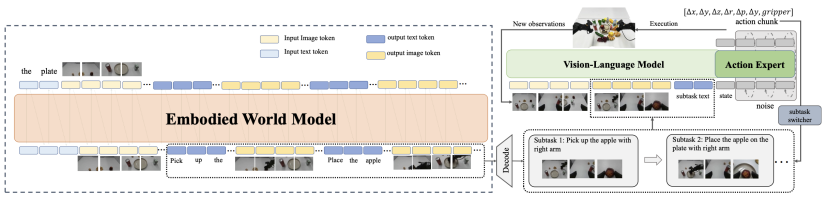

世界模型规划+GoalVLA执行,双层协同

VISTA 采用分层解耦的设计理念,将复杂机器人操作拆分为高层任务规划与底层动作执行两个相对独立又深度协同的模块,彻底告别传统端到端 VLA 模型 “指令直接生动作” 的单一范式。这种结构既可以利用大规模预训练世界模型的强泛化能力,又能让底层执行策略专注于精准控制,在稳定性、泛化性和数据效率上实现全面提升。

作为整个系统的 “大脑” 与规划核心,具身世界模型负责将自然语言指令转化为机器人可理解、可执行的多步规划。它以初始观测图像和全局语言指令为输入,通过大规模预训练学到的物理规则、空间结构与操作常识,将长时序、复杂的操作任务自动拆解为一系列简单、有序、可完成的原子子任务。

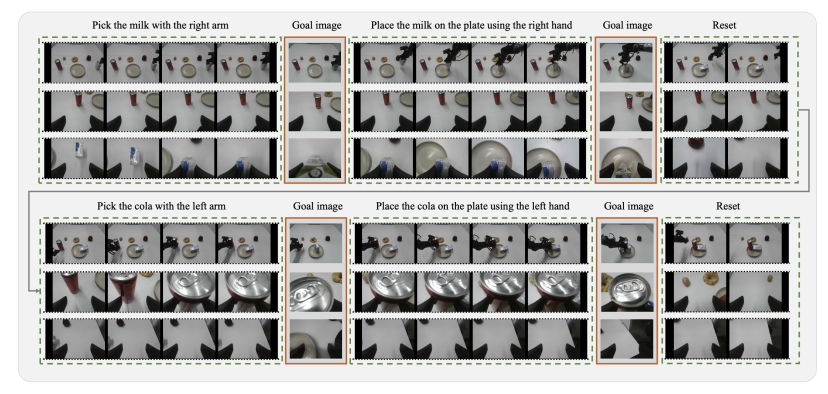

与π0.7 依赖 VLM 先行分解指令再将子任务输入世界模型生成subgoal图像不同,VISTA 交替地为每一步子任务生成对应的子任务文本指令和视觉目标图像,同时具备规划与生成能力。这些目标图像不是连续的视频帧,而是任务关键节点的 “视觉里程碑”,具备物理合理性、多视角空间一致性和语义对齐性,能够清晰展示机器人完成该子任务后应该呈现的状态,包括机械臂姿态、物体位置、夹持器开合程度等。这种视觉目标为机器人提供了语言无法精确描述的空间约束与物理先验,从根本上提升执行可靠性。

GoalVLA 是系统的 “手”,负责将规划转化为真实动作。它不再像传统 VLA 那样仅依赖文本指令,而是以当前观测图像 + 文本子任务 + 视觉目标图像三者作为输入,联合推理出最优动作序列。这种多模态输入让机器人不仅知道 “要做什么”,更清楚 “该怎么做”以及“要做到什么样子”。

在视觉目标的强引导下,GoalVLA 可以精准理解抓取位置、放置姿态、物体相对位置等信息,即使面对从未见过的物体,也能通过视觉类比完成稳定操作。同时,模型在训练中引入子任务边界优化与目标图像偏移增强,让机器人在子任务切换时更平滑、对视觉目标的微小偏差更鲁棒,从而在真实机器人上实现稳定、闭环的精准控制。

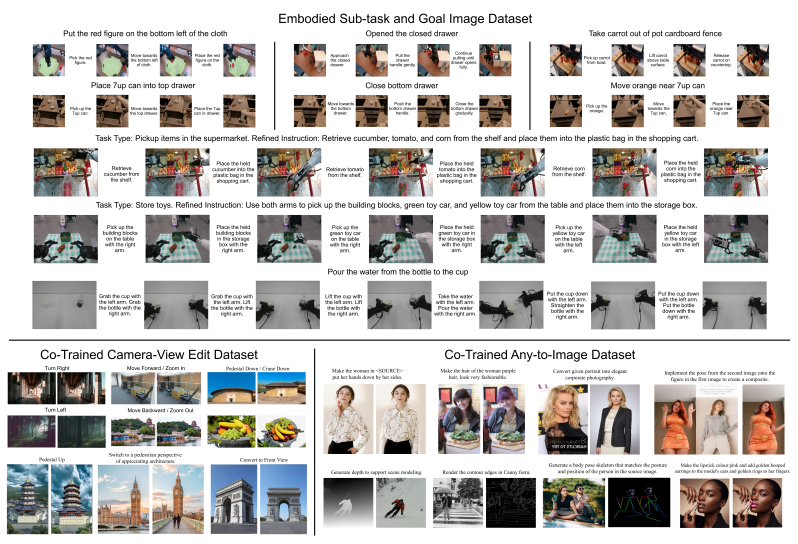

为支撑世界模型的大规模预训练,研究团队构建了一套全自动机器人轨迹处理流水线。现有公开机器人轨迹数据通常仅包含全局指令与动作序列,缺少中间子任务与目标状态标注,难以直接用于世界模型训练。

该自动化流程通过运动轨迹分析、夹持器状态变化检测,自动识别子任务边界;再通过大模型语义标注,生成简洁精准的文本子任务描述,最终将百万级原始轨迹转化为文本子任务+视觉目标图像交替的结构化数据,为世界模型的通用规划能力打下坚实数据基础。

多场景、多维度突破世界模型泛化边界

VISTA在视觉subgoal生成上,展现出远超传统方法的多维度能力,可适应真实场景中的各类复杂挑战。

在分布外全新场景中,即便基于合成图像或手机拍摄的真实照片构建与训练数据完全不同的环境,VISTA 依然能够生成物理合理、动作连贯的子任务序列与目标图像,基本不会出现物体粘连、机械臂姿态畸形、空间位置错乱等典型幻觉问题。模型可以在完全陌生的物体外观、场景布局、背景纹理和相机视角下,保持稳定的任务规划能力,真正实现零样本场景泛化。

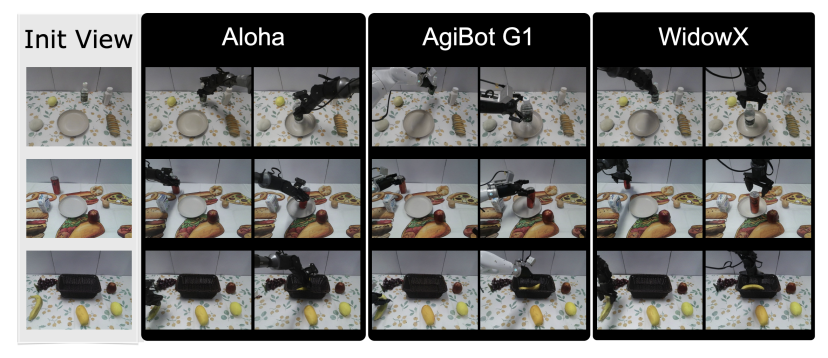

在多视角观测下,VISTA 的生成能力进一步体现出硬核优势。模型可以同步为机器人头部相机、左手腕相机、右手腕相机生成目标图像,并且三路图像保持良好的空间一致性,精准还原物体之间的相对位置、机械臂执行姿态以及抓取点位关系。这种强多视角一致性意味着模型具备可靠的 3D 空间推理能力,能够为底层执行提供统一、无冲突的空间约束。

同时,VISTA 具备强大的跨具身迁移能力,无需针对不同机器人本体重新训练,同一模型即可为 Agilex Aloha、AgiBot G1、WidowX 等不同类型、不同结构的机器人平台,生成适配其本体结构的子任务序列与目标图像。这种跨具身迁移能力大幅降低了机器人策略适配成本,让一套规划模型可以在多机型上通用,是迈向通用机器人操作系统的关键特性。

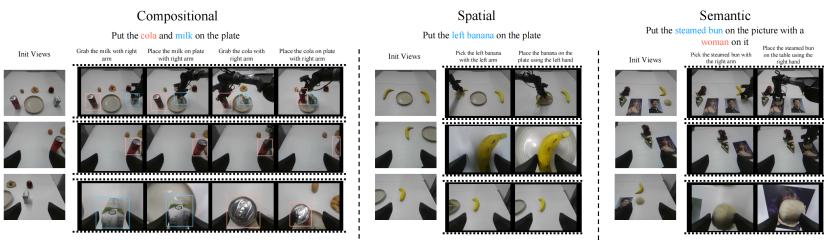

更值得关注的是,VISTA 能够轻松处理组合操作、空间理解、语义理解类复杂任务,而这正好弥补了传统 VLA 模型在细粒度理解上的不足。在组合任务上,模型可以同时规划多个物体的操作序列,保持时序与空间逻辑一致;在空间理解上,模型能够精准响应 “左边的物体”“放在右侧盘子”“靠近芒果” 等方位指令;在语义理解上,模型可根据 “圆形盘子”、“方形盘子”、“放在人物照片上” 等抽象语义描述生成对应的视觉目标,完成更高难度的指令遵循。

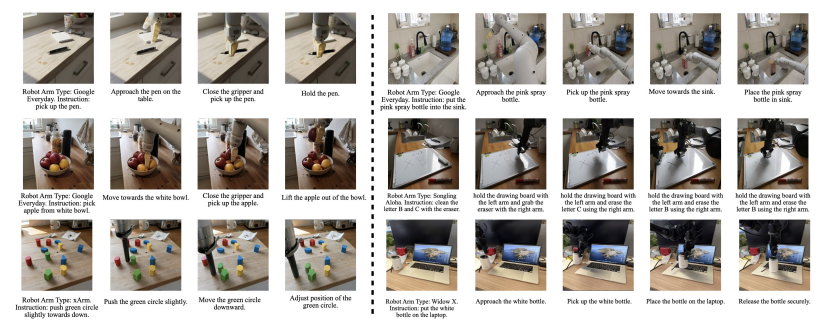

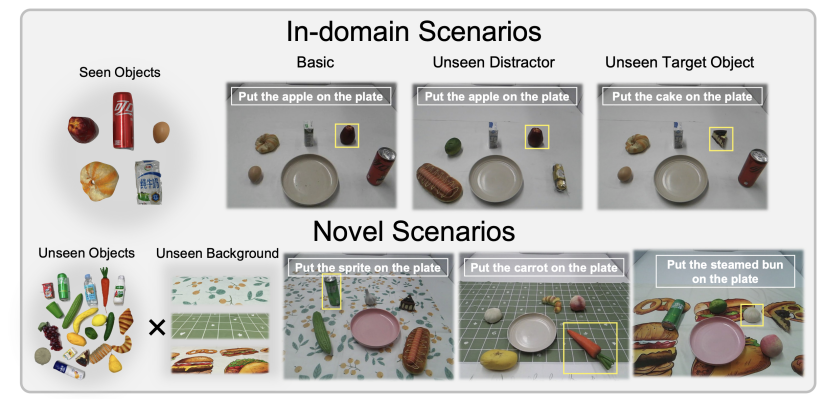

研究团队在真实机器人平台上,设计了严格的域内与分布外对比实验,最大程度模拟机器人在现实中遇到的陌生物体、复杂干扰与全新布局。。

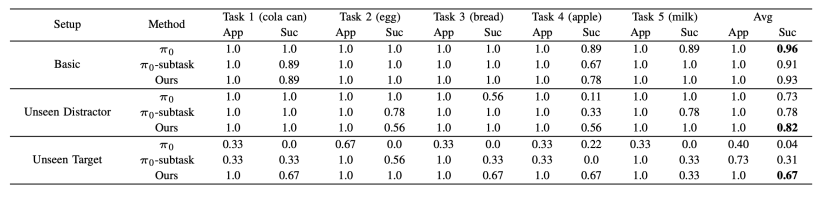

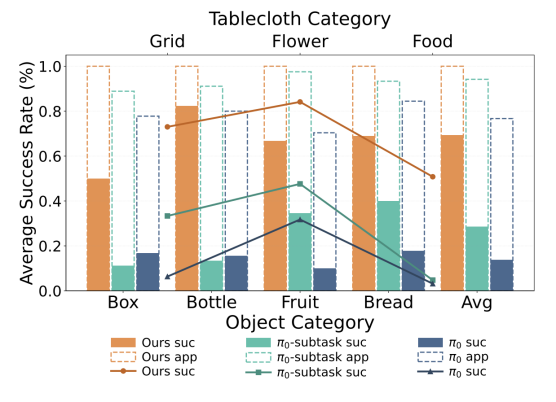

实验训练数据仅使用鸡蛋、可乐罐、苹果、牛奶盒、牛角包5个物体,采集2小时真机遥操作数据,共737条轨迹;测试场景则覆盖21个完全未见物体、3种花纹桌布与全新场景布局,总计63个分布外场景。

实验结果极具说服力:在全新分布外场景中,传统SOTA端到端VLA模型π0成功率仅14%,而VISTA将成功率提升至69%;在未见目标物体场景下,VISTA的接近成功率接近100%,执行成功率大幅领先;在复杂视觉干扰下,模型性能下降幅度远小于基线,展现出极强鲁棒性。

在基础场景下,所有模型都能保持较高性能,VISTA 与基线 π0 均能稳定完成任务,平均执行成功率超过 90%,说明在熟悉环境中,各类方法都具备可靠的执行能力。

进入未见干扰物场景,传统模型的性能开始出现明显下降。π0 的平均执行成功率从 96% 下滑至 73%,尤其是在苹果等需要精细抓取的物体上,成功率仅为 11%。π0-subtask 通过文本子任务引导获得一定提升,但仍难以稳定执行。相比之下,VISTA 凭借视觉目标提供的强空间约束,有效抵抗干扰物影响,平均执行成功率达到82%,在各类物体上均保持更稳定的表现。

在未见目标物体这一严苛的设置下,传统方法几乎完全失效。π0 的平均执行成功率仅为4%,接近成功率也不足 50%,模型无法在全新物体上实现有效定位与抓取。π0-subtask 通过子任务指令将接近成功率提升至 73%,但执行成功率依然仅有 31%,说明纯文本引导无法提供足够的空间与姿态信息。而VISTA 则展现出颠覆性的提升:接近成功率达到 100%,平均执行成功率高达67%,在多种形态差异显著的未见物体上均能完成稳定操作。这一结果直接证明,视觉目标图像为机器人提供了关键的空间先验与姿态参考,使模型在完全陌生的目标上依然能够精准执行。

而在最严苛的三种未见桌布+21种未见物体组合而成的全新场景下,π0的成功率仅14%,而 VISTA 凭借世界模型提供的视觉subgoal与空间先验,将整体成功率大幅提升至69%,实现了接近 5 倍的性能飞跃,充分证明其在开放、未知、高视觉干扰真实场景中的压倒性优势。

从定性执行效果来看,基线模型在面对未见物体时,频繁出现抓取姿态错误、目标误识别等问题,最终任务失败;而VISTA借助精准的视觉目标引导,可稳定完成抓取、放置全流程,充分验证视觉subgoal对执行精度的关键作用。

在真机实际运行中,GoalVLA能够稳定对齐世界模型生成的视觉目标。无论是组合操作、空间区分、语义理解类任务,机器人最终执行姿态均与目标图像高度一致,多物体、多姿态操作均保持可靠执行。

同时,研究团队客观分析了当前方法的局限性。目前真机实验主要集中在拾取-放置任务,部分失败案例源于目标图像时序偏差或轻微空间偏移;未来工作将进一步提升目标生成精度,并扩展至液体倾倒、可变形物体操作、复杂装配等更多任务类型。

对于行业来说,VISTA框架的核心价值,在于首次验证了大规模预训练具身世界模型在机器人操作中的关键作用。通过分层规划+视觉目标引导,模型解决了传统VLA“语义能理解、空间难感知、执行易失败”的痛点,在极低真机数据成本下实现了强大的分布外泛化能力。

从 VISTA 到后续的 π 0.7模型,一系列前沿工作共同指向一个结论:单纯依靠文本引导的端到端 VLA,已经很难实现真正的零样本泛化。如何更高效、更稳健地利用外部知识去指导 VLA,成为能否迎来机器人领域 “GPT-3 时刻” 的核心途径。

视觉subgoal相较于纯文本子任务,拥有更丰富、更精准、更可对齐的空间与物理信息,也正是这种信息优势,让机器人系统涌现出更强的语义理解、空间理解与推理能力,真正走向跨场景、跨任务、跨本体的泛化。面向下一代通用机器人系统,如何更深度激发世界模型的基础常识与物理能力,如何设计更鲁棒、更轻量化、更可泛化的世界模型与机器人策略之间的接口,如何在保证精度的同时降低对高质量视觉输出的依赖,将成为决定通用机器人能否走向现实的关键问题。