阅读时间大约9分钟(3228字)

阅读时间大约9分钟(3228字)

7小时前 拒绝内卷!谢赛宁与杨立昆的“反向OpenAI”,能赌对世界模型的未来么?

作者:赵鹏程 出品:机器人产业应用

前言

2026年3月,AI圈爆出一则足以打破行业格局的融资新闻——图灵奖得主杨立昆与青年华人学者谢赛宁联手创立的AMI Labs,仅25人团队、尚未推出任何产品,就斩获10.3亿美元Seed轮融资,投前估值高达35亿美元,创下欧洲历史最大Seed轮融资纪录。

AMI Labs被谢赛宁定义为“反向OpenAI”的实验室,跳出LLM内卷赛道,押注“世界模型”这一争议赛道。但很少有人知道,同样叫“世界模型”,英伟达、李飞飞、杨立昆与谢赛宁团队的布局截然不同;而谢赛宁团队深耕的,是短期无盈利、长期能改写具身智能格局的技术路径,其中藏着世界模型的核心技术逻辑与长期价值。

01

反向OpenAI:谢赛宁与杨立昆的初心,拒绝硅谷“军备竞赛”

谢赛宁的科研轨迹,早已为这场“反向”创业埋下伏笔。从上海交大ACM荣誉班起步,他便聚焦“让机器真正理解世界”这一核心命题,随后在新加坡国立大学交流、纽约大学深耕期间,更是沿着“表征学习”的脉络持续探索,一步步搭建起通往世界模型的技术基石。

在加入Meta的FAIR(人工智能研究院)后,谢赛宁的研究进一步贴近“世界理解”的核心,先后主导或参与研发了ConvNeXt、MoCo、MAE等重量级成果,更关键的是,他研发的DiT架构(Sora核心技术之一),为后续世界模型的“物理规律模拟”奠定了核心技术基础。

在FAIR期间,他与杨立昆共事多年,两人在“AI应摆脱符号层面,真正理解物理世界”的理念上高度契合,也共同意识到硅谷商业化内卷对基础研究的挤压。

正是这一系列长期的技术积累、对核心命题的坚守,以及与杨立昆的理念共鸣,让他最终选择从Meta离职,与杨立昆联手创立AMI Labs,践行“反向OpenAI”的初心,将多年的科研积累落地到世界模型的研发中。

不久前,谢赛宁在采访中(张小珺商业访谈录)直白地解释:“正向的OpenAI是将互联网作为发源地,下载海量的文本数据,用Transformer架构训练出GPT这类大语言模型再推向市场;而世界模型无法从互联网下载,我们要做的,是‘下载人类’——把人类对世界的感知、决策、推理能力,内化为模型的核心能力。”

这份“反向”,本质上也是对硅谷行业环境的反抗。谢赛宁这样描述硅谷的现状:“硅谷核心模型训练部门必须卷到最前面,为了更好的商业化变现,各个大厂变成了军备竞赛,但这会压榨科研的空间,抽走自由探索的氧气。”。

而AMI Labs在全球设立了四个跨国办公室,汇聚了来自OpenAI、DeepMind、xAI的研究者,他们不追求IPO,不急于盈利,唯一的目标,就是通过基础研究,影响AI的下一个进程——这也是他们选择世界模型的核心初心。

02

同叫“世界模型”:内核天差地别

当AMI Labs押注世界模型时,行业内早已掀起布局热潮,但必须明确一个核心认知:当前世界模型仍处于行业初期,尚未形成统一的技术标准和定义。

外界口中的“世界模型”,其实并不是一条统一的技术路线,更像是一个行业共识性的“目标”——大家都想让AI理解物理世界,但选择的路径截然不同。

这也导致一个普遍痛点:如果分不清不同团队的核心布局,就很难看懂,为什么英伟达能率先实现盈利,为什么李飞飞的路线更容易产品化,而杨立昆与谢赛宁的路线,却最远、最难,短期看不到回报。接下来,我们就明确区分这三种主流路线,读懂它们的核心差异与背后逻辑。

要理解这种差异,首先要明确谢赛宁口中世界模型的核心定义,这一概念源自1943年心理学家Kenneth Craik,他认为人类大脑中就存在这样的“世界模型”,能通过预测动作后果指导决策,简单来说,LLM是“预测token”,而世界模型是“预测世界”,前者停留在符号层面,后者则深入物理世界的规律的核心——这也是不同团队布局差异的根源,更是三者商业化难度、路线远近不同的核心原因。

路线一:英伟达——商业化先行,靠仿真基础设施快速盈利。在三种路线中,英伟达是最务实、最注重短期回报的一个,也是目前唯一能实现盈利的一个。

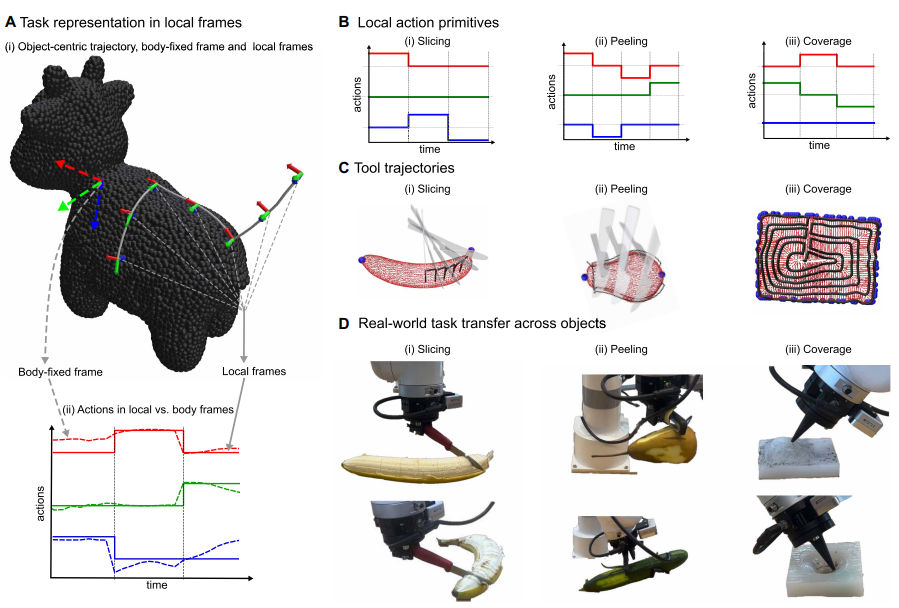

英伟达直接将世界模型做成了可落地、可变现的产品,核心方向是搭建能批量生成物理环境的仿真基础设施。其技术逻辑是,通过精准模拟真实世界的物理规律(如重力、摩擦力、物体碰撞关系),构建大规模虚拟训练环境,让AI在虚拟场景中完成海量训练,再迁移到真实场景。

这种路线之所以能快速赚钱,核心在于其精准对接了元宇宙、自动驾驶、机器人仿真等成熟商业化场景——这些领域对虚拟训练环境的需求迫切,愿意为高质量的仿真基础设施付费,因此能率先实现盈利。

路线二:李飞飞——聚焦空间智能,易产品化落地。李飞飞的布局,介于英伟达的商业化与谢赛宁的长期主义之间,核心优势是“易产品化”,更容易快速落地到具体场景。

她的路线聚焦于“空间智能”,技术核心是“显式的3D表征”。作为计算机视觉领域的先驱,李飞飞在World Labs中押注的,是让机器真正理解三维空间和物体关系的世界模型,她将其称为“空间的代码”。

其技术逻辑是,通过构建精准的3D空间模型,让机器清晰识别物体的位置、形态、相互作用关系,实现100%的空间逻辑正确性。

这种世界模型更注重“感知层面的精准度”——而这种能力,能直接落地到机器人导航、AR/VR、工业检测等场景,应用场景明确,技术研发聚焦于“感知层面”,难度低于认知型路线,因此更容易实现产品化。(国内栩峰科技与李飞飞团队深耕的 3D 路线相同,详情可参考文章:专访栩峰科技赵鹭&余豪:空间智能与世界模型,如何引领重构物理世界的AI革命?)

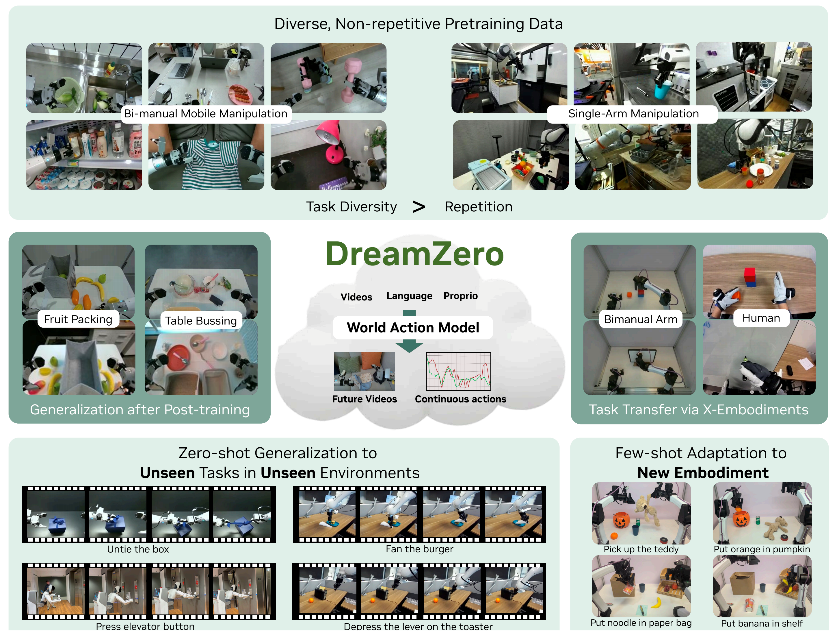

路线三:杨立昆&谢赛宁——深耕认知架构,路线最远也最难。与前两者相比,杨立昆与谢赛宁团队的路线,是最“反商业化”、难度最高、周期最长的一个,也是短期看不到盈利希望的一个。

他们的追求更偏向“认知层面”,核心目标是打造能真正模拟人类大脑的“预测大脑”,让AI具备因果推理和长期规划能力——这也是世界模型最核心、最本质的目标,却也是最难实现的。

杨立昆毕生的目标,是打造能够进行因果推理和长期规划的认知架构;而谢赛宁以首席科学家的身份加入AMI,核心就是让模型实现“反事实推理”“因果推理”和“长期规划”,技术上以“state预测”为核心,结合联想记忆能力,让模型不仅能预测下一个状态,还能推演“如果做了不同动作,会产生什么不同结果”。

这种路线之所以最远最难,核心在于其研发的是模型的“认知能力”,而非简单的“仿真”或“感知”,需要突破的技术瓶颈极多,且无法快速对接商业化场景,因此要承担短期变现困难的压力,路线也最遥远。

03

谢赛宁的世界模型,藏着“预测大脑”的核心逻辑

明确了谢赛宁团队与英伟达、李飞飞的路线差异后,更关键的是读懂其世界模型的核心能力——不同于前两者侧重“仿真”或“感知”的浅层能力,谢赛宁的世界模型以“预测大脑”为核心,核心目标是让AI具备“预测世界、指导决策”的能力,而非像LLM那样停留在“预测下一个字符”的符号层面,这也是其区别于LLM、实现“真正理解世界”的核心支撑,更是其长期主义研发的核心方向。

谢赛宁的世界模型,本质是模拟人类大脑的认知模式,这一点从他对人类智能体系的解读中就能清晰体现。

他引用强化学习之父Richard Sutton在Dyna论文中的观点,将人类智能分为两种策略,这也是其世界模型的核心能力基础,对应着人类认知中“快思考”与“慢思考”的逻辑:

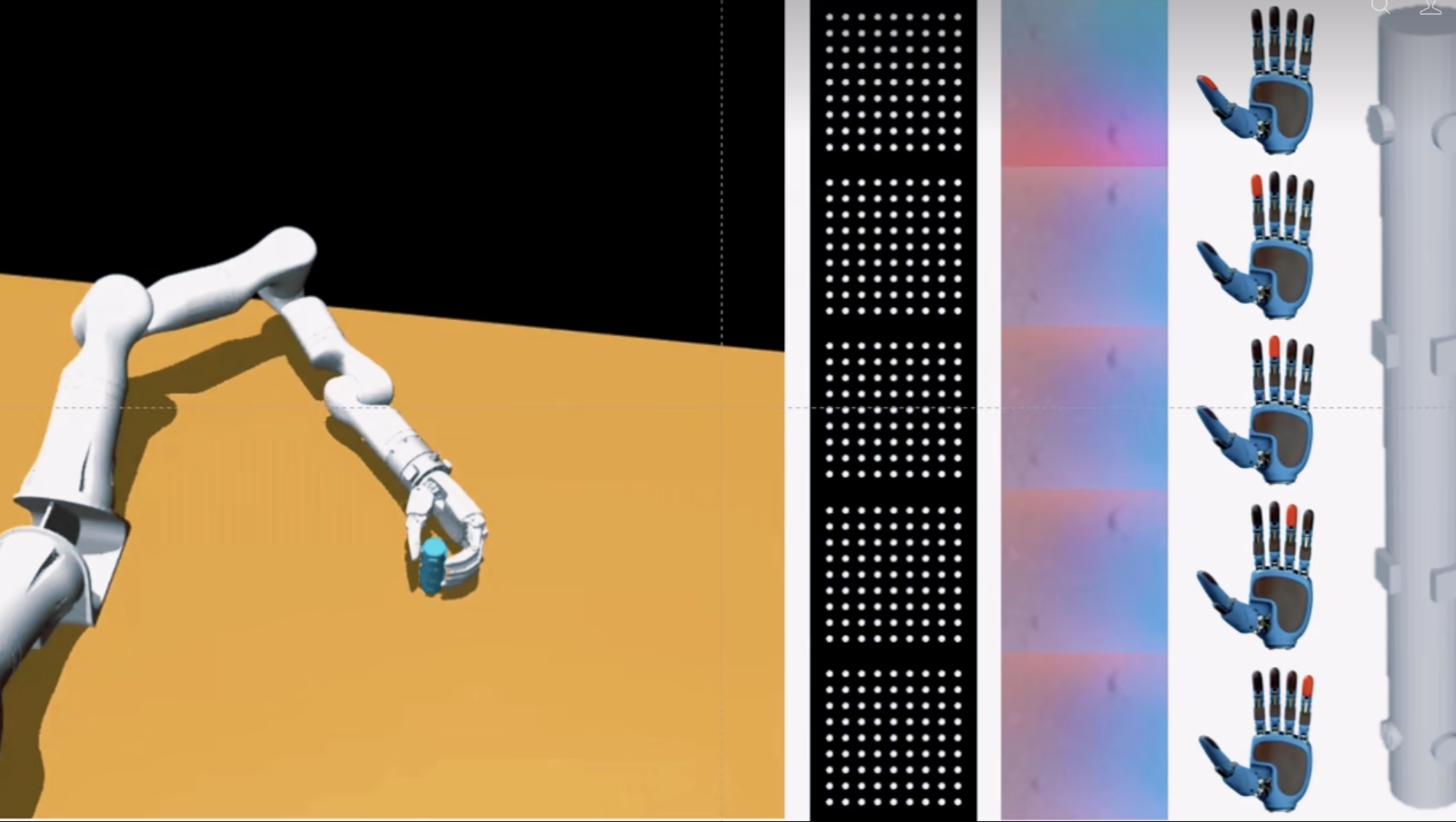

system one(系统1)对应reactive policy(反应式策略),类似人类的肌肉记忆,比如熟练开车时无需刻意思考就能完成转弯、刹车等动作,决策已内化为习惯;

system two(系统2)对应model-based policy(基于模型的策略),类似人类的“慢思考”,需要投入更多脑力分析规划,比如刚学开车时,要反复斟酌油门与刹车的配合,预判路况做出决策。

谢赛宁的世界模型,正是要实现这两种策略的深度融合,面对简单常规场景快速反应提升效率,面对复杂未知场景启动“慢思考”,基于对世界的理解规划决策,打破传统AI的局限,向类人智能靠近。

而这一切能力的核心,离不开对“state(状态)”的精准预测,这也是谢赛宁的世界模型与LLM最本质的区别。LLM的核心是“predict next token(预测下一个字符)”,本质上只是对语言符号的统计拟合,即便能生成看似有逻辑的文本,也只是对训练数据的模仿,无法真正理解物理世界的规律,更谈不上因果推理。

但谢赛宁的世界模型,核心是“基于action(动作),predict next state(预测下一个状态)”:给定当前环境的状态st,模型能通过转移函数f,结合施加的动作at,精准预测下一个时刻的状态st+1,这种预测背后是对物理世界规律的深度理解,更能实现谢赛宁强调的“反事实推理”——推演“如果做出不同动作,会产生什么不同结果”,这也是模型实现长期规划、解决真实世界复杂问题的核心前提。

这种聚焦“类人认知”与“state预测”的核心逻辑,也解释了谢赛宁为何选择长期主义——这些能力的突破无法通过短期商业化迭代实现,需要长期深耕基础研究,摆脱硅谷“军备竞赛”的浮躁,这也正是其路线“最远、最难”的核心原因,但一旦突破,将彻底改写具身智能的格局。

04

结语

LLM的热度逐渐褪去,随着机器人赛道的火爆,世界模型成为行业的下一个“兵家必争之地”,英伟达的商业化、李飞飞的空间智能、杨立昆与谢赛宁的认知架构,或许没有绝对的对错。但谢赛宁的选择,也提醒我们:AI的进步,仍然需要那些立意长远、做长期研究的人们。

谢赛宁与杨立昆的“反向OpenAI”,赌的不是短期的融资神话,而是世界模型的终极未来——一个能真正理解物理世界、赋能具身智能,让AI从“语言符号”走向“真实行动”的未来。

这场赌局的输赢,或许需要5年、10年甚至更久来验证。